Deepfake-Identitätserkennung: Praxisguide 2026 mit KI

Deepfake-Identitätserkennung ist im Jahr 2026 ein dringendes Thema, da KI-generierte Gesichtstauschungen, Stimmklonungen und Identitätsmanipulationen immer realistischer und zugänglicher werden. Es ist nun möglich, Beiträge in sozialen Medien, Nachrichten von Unternehmen und sogar persönliche Aufnahmen mit krankhafter Präzision zu bearbeiten. Solche künstlichen Videos haben das Potenzial, Rufschädigungen zu verursachen, Finanzbetrug zu erleichtern oder Fehlinformationen zu verbreiten, noch bevor das Publikum den Fake bemerkt. Dennoch wird es immer schwieriger, Deepfakes zu erkennen. Minimale Manipulationsartefakte können in hochauflösenden Bildern und durch Komprimierung auf Plattformen verborgen sein. Obwohl KI-Videoverbesserung nützlich ist, um übersehene Inkonsistenzen aufzudecken, ersetzt sie kein spezialisiertes Erkennungssystem. Vielmehr verbessert sie die Ermittlungsprozesse. Um wirksam gegen identitätsbasierte Deepfake-Betrügereien zu schützen, ist es entscheidend zu verstehen, was Deepfake-Erkennung bedeutet, warum sie wichtig ist und wie praktische Analysetools strukturierte, verantwortungsbewusste Verifizierungsprozesse unterstützen können.

Teil 1: Was Deepfake-Identitätserkennung bedeutet und wie sie funktioniert

Deepfake-Identitätserkennung bezeichnet den Prozess der Untersuchung von Online-Audio- oder Videomaterialien, um festzustellen, ob die Identität einer Person künstlich mithilfe von KI-Algorithmen verfälscht wurde. Im Gegensatz zu herkömmlichen Formen der Videobearbeitung, wie einfachen Filtern, Zuschneiden oder Helligkeitsanpassungen, beinhalten Deepfakes die künstliche Erstellung oder Veränderung von Gesichtern und Gesichtsausdrücken sowie gelegentlich auch der Stimme mittels maschineller Lernalgorithmen.

Die häufigsten Manipulationen der Identität durch Deepfaking sind:

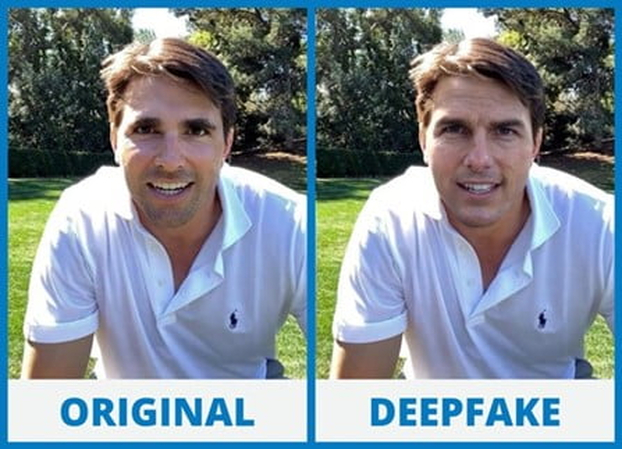

- Face Swapping: Die Verwendung eines Videos einer anderen Person, bei dem dessen Gesicht durch das eines anderen ersetzt wird.

- Expression Mimicry: Die Übertragung von Gesichtsausdrücken eines Quellakteurs auf eine Zielidentität.

- Voice Replication: Klonen von Stimmmustern und Tonlagen in kurzen Aufnahmen.

- Identity Blending: Feine Änderungen der Merkmale, sodass eine Person wie jemand anderes aussieht.

Der Unterschied zwischen Deepfake und gewöhnlicher Bearbeitung liegt im Realismus. KI-Systeme arbeiten mit Tausenden oder Millionen Referenzbildern, simulieren überzeugende Gesichtsausdrücke und Beleuchtung und erzeugen realistische Bilder. Deshalb ist die Manipulation bei oberflächlicher Betrachtung nicht leicht erkennbar.

In seiner einfachsten Form beinhaltet Deepfake-Identitätserkennung das frühzeitige Erkennen manipulierter Inhalte, um Schäden zu verhindern. Es umfasst systematische Überprüfung, Kenntnis der Manipulationsmethoden und zunehmend KI-gesteuerte Analysetools.

Teil 2: Warum Deepfake-Identitätserkennung im Jahr 2026 entscheidend ist

Die Deepfake-Erkennung ist zu einer äußerst dringenden Aufgabe geworden. KI-gesteuerter Identitätsbetrug beschränkt sich nicht mehr auf experimentelles Internetmaterial, sondern zeigt sich in Betrug, Desinformationskampagnen und sogar gefälschten Beweisen.

Echte Situationen umfassen:

- Soziale Medien-Betrug: Hier verwenden Menschen face-swapped Videos, um sich als Influencer oder Verwandte auszugeben.

- Unternehmens-Imitation: Gefälschte Video-Botschaften von Führungskräften, die Mitarbeiter anweisen, Geld zu überweisen.

- Rechtliche Manipulation: Bearbeitete Videoaufnahmen, die als gefälschte Beweise erscheinen.

- Politische Verzerrung: Politische Figuren werden dargestellt, als hätten sie Dinge gesagt, die sie nie gesagt haben.

Behörden wie das Federal Bureau of Investigation und Europol haben mehrfach vor der zunehmenden Komplexität KI-gestützten Betrugs gewarnt, der auch Identitätsbetrug mittels synthetischer Medien umfasst. Solche Warnungen beziehen sich auf reale Fälle, bei denen Unternehmen erhebliche Geldsummen durch KI-generierte Führungskräfte-Imitationen verloren.

Hohe Videoauflösung bedeutet nicht Authentizität. Manipulation kann selbst in 4K-Aufnahmen verborgen sein, da:

- Soziale Plattformen starke Kompression anwenden.

- Unstimmigkeiten in der Beleuchtung für das Auge natürlich erscheinen.

- KI-Modelle realistische Hauttexturen und Mikroexpressionen erzeugen.

- Frame-Blending Nähte kaschieren kann.

Im professionellen Umfeld reicht menschliche Wahrnehmung nicht aus. Fehlidentifikation, d.h. das Nicht-Erkennen von Deepfake-Inhalten oder das Fälschlicherweise-Kennzeichnen legitimer Inhalte als Fake, kann sehr teuer sein. Deshalb müssen aktive Erkennungstechniken 2026 zentral sein.

Teil 3: Wie Deepfake-Identitätserkennung in der Praxis funktioniert

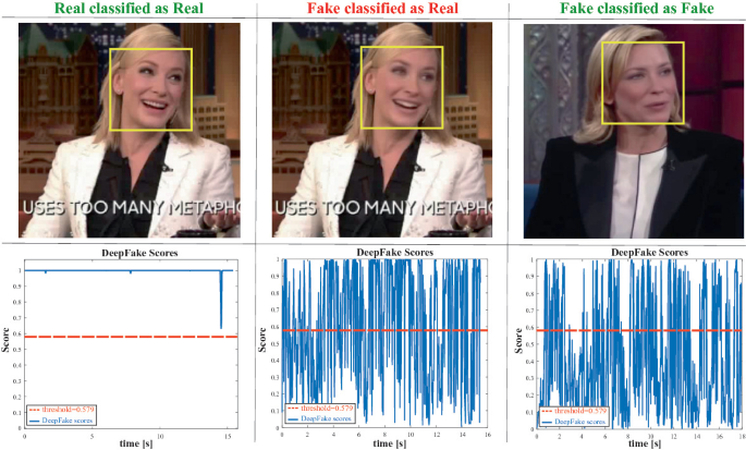

Deepfake-Identitätserkennung basiert auf KI-Analyse und algorithmischer menschlicher Überprüfung. Die aktuell modifizierten Erkennungssysteme analysieren winzige Muster, die mit bloßem Auge nicht erkennbar sind.

1. Analyse der Gesichtslandmarken

Erkennungsmodelle prüfen die Konsistenz der Gesichtsgeometrie von Frame zu Frame. KI-erstellte Face Swaps können die Abstände zwischen Mund, Kinnlinie und Augen verzerren. Diese Verzerrungen können sich abnormal verändern, wenn das Subjekt den Kopf dreht.

2. Mikro-Expressions-Tracking

Die Muskeln des menschlichen Gesichts erzeugen Mikroexpressionen entsprechend natürlichen biomechanischen Parametern. Synthetische Modelle sind bei großen Bewegungen realistisch, versagen jedoch bei der Kontrolle unwillkürlicher Mikrobewegungen an Augen- und Wangenrändern.

3. Konsistenz von Beleuchtung und Schatten

Deepfakes passen Schatten oder Reflexionen nicht richtig an. Die Lichtquelle im Gesicht stimmt nicht notwendigerweise mit der Umgebung oder den Augenreflexionen überein.

4. Erkennung von Kompressionsartefakten und Rauschen

Jedes Aufnahmegerät erzeugt charakteristische Rauschmuster. Deepfake-Überlagerungen verändern die Verteilung von Körnung oder Kompressionsartefakten, die nicht mit benachbarten Bereichen übereinstimmen.

5. Temporale Kohärenz

Konsistenz von Frame zu Frame ist wichtig. Zittern oder unnatürliches Glätten zwischen Frames können auf synthetische Erzeugung hinweisen.

Das Hauptproblem menschlicher Inspektion ist, dass unser Gehirn sich meist auf vertraute Gesichter konzentriert, nicht auf Pixel. KI-basierte Detektoren können winzige statistische Variationen in Tausenden von Frames in Sekunden analysieren.

Gleichzeitig kann dieser Prozess durch Videoverbesserung unterstützt werden. Enhancement-Tools klären Details, reduzieren Unschärfe, maximieren Auflösung und machen verborgene Anomalien sichtbarer für manuelle oder automatische Prüfung. Es ist jedoch keine Detektion, sondern Vorbereitung für die weitere Analyse.

Teil 4: Einsatz von Videoverbesserung zur Unterstützung der Deepfake-Identitätserkennung

Videoverbesserung dient der vertieften Analyse von Identitäten, indem sie die visuelle Sichtbarkeit verbessert. Die meisten verdächtigen Videos stammen von sozialen Medien, Messaging-Apps oder Videoüberwachung. Diese Dateien sind oft:

- niedrig aufgelöst.

- mehrfach komprimiert.

- von Bewegungsunschärfe und Rauschen betroffen.

- schlecht beleuchtet.

Diese Einschränkungen können Manipulationsspuren verbergen.

Die Qualitätsverbesserung von Videos kann verwendet werden, um aufzudecken:

- Kanteninkonsistenzen zwischen Gesicht und Hintergrund.

- Geglättete oder unnatürliche Hauttexturen.

- kleine Lichtunstimmigkeiten.

- Artefakte durch Frame-Blending an Gesichtskonturen.

Zum Beispiel kann das Schärfen von Kanten kleine Halo-Effekte am Kinn in face-swapped Videos offenlegen. Unregelmäßige Körnung kann durch Rauschreduzierung sichtbar gemacht werden. Unregelmäßiges Blinzeln oder Augenreflexionen sind durch Hochskalierung besser erkennbar.

Wichtig: KI-Videoverbesserung ist ein Vorbereitungsprozess. Sie macht Inhalte weder echt noch falsch, sondern bringt sie näher an die Inspektion – durch menschliche Augen oder spezialisierte forensische Software.

Verbesserung kann korrekt eingesetzt Transparenz schaffen und Beweise nicht verfälschen. Um die Integrität der Beweise zu gewährleisten, wird empfohlen, Originaldateien aufzubewahren und an Kopien zu arbeiten.

Teil 5: Wie HitPaw VikPea praktische Deepfake-Identitätserkennung unterstützt

HitPaw VikPea ist ein hochwertiger, KI-gesteuerter Videoverbesserer, der zur Reparatur und Verbesserung der Videoqualität verwendet wird. Obwohl es keine dedizierte Deepfake-Erkennungsplattform ist, ist es eine praktische Hilfskomponente im Deepfake-Identitätsanalyseprozess.

Klarheit ist wichtig bei der Analyse dubioser Inhalte, z. B. fragwürdiger Führungskräfteaussagen oder viraler Social-Media-Videos. HitPaw VikPea kann:

- verblasste Gesichtszüge wiederherstellen.

- Kompressionsrauschen reduzieren.

- Gesichtskonturen schärfen.

- die Auflösung der Frames erhöhen.

- fein strukturierte Haut und Lichteffekte verbessern.

Diese Verbesserungen ermöglichen es Analysten, Gesichtslandmarken und Ausdrucksänderungen präziser im Rahmen von Unternehmensvideo-Audits, Social-Media-Prüfungen oder minderwertigen Aufnahmen zu analysieren.

Hauptmerkmale von HitPaw VikPea

Im Kontext der Deepfake-Identitätsprüfung sind mehrere Funktionen besonders relevant:

- KI-Video-Reparatur: Repariert beschädigte oder fehlerhafte Videoteile, forensische Untersuchungen sind möglich.

- Farbkorrektur: Fügt Schwarz-Weiß- oder ausgewaschenen Videos Farbe hinzu und verbessert die Kontextqualität.

- Video auf 4K hochskalieren: Verbessert das Video auf 4K, um wichtige Einzelheiten für die Analyse hervorzuheben.

Diese Eigenschaften unterstützen eine sorgfältige Prüfung, unterscheiden Medien jedoch nicht eigenständig als echt oder verändert.

Wie man Deepfake-Videos mit HitPaw VikPea verbessert

Schritt 1: Installation und Download

Besuchen Sie die offizielle Webseite und laden Sie HitPaw VikPea herunter. Nach der Installation starten Sie die Anwendung und melden sich bei Bedarf an.

Schritt 2: Video in den Video Enhancer laden

Klicken Sie im linken Panel auf das Modul Video Enhancer. Drücken Sie das Symbol, um Ihre Videodatei in die Benutzeroberfläche zu importieren.

Schritt 3: Passendes KI-Modell wählen

Neben einem allgemeinen Modell zur Gesamtverbesserung gibt es mehrere spezialisierte Modelle, die je nach Bedarf auf das Video angewendet werden können.

Für Deepfake-Identitätserkennung ist das beste Modell von VikPea das Portrait Restoration Model, das die Gesichtszüge weiter verfeinert.

Sie können auch andere Modelle wie das UlHD Restoration Model verwenden, das die Videoqualität eines hochauflösenden 720p-Videos weiter verbessert, die Sichtbarkeit erhöht und die Schärfe wiederherstellt.

Wählen Sie die Vorschaulänge (3 oder 5 Sekunden). Wenn nur wenige Elemente verbessert werden sollen, verwenden Sie das Cut-Werkzeug. Stellen Sie die Ausgabeauflösung und das Format ein.

Tipps: Wenn Sie unsicher sind, welches Modell zu verwenden ist, nutzen Sie den AI Pilot. Dieser untersucht automatisch Ihr Video und empfiehlt die passendste Verbesserung.

Schritt 4: Vorschau und Speichern

Nach allen Anpassungen klicken Sie auf Vorschau, um die Vorher-Nachher-Ergebnisse zu vergleichen. So sehen Sie klar den Unterschied zwischen Original und verbesserter Version, bevor Sie finalisieren.

Schritt 5: Export oder Cloud-Export

Wenn Sie mit der Vorschau zufrieden sind, wählen Sie Export oder Cloud Export, um das Video zu speichern. Genießen Sie verbesserte Videos mit beeindruckender Klarheit.

Tipps für bestmögliche Ergebnisse

- Vorhersehbare Änderungen nutzen, um die Klarheit der Gesichtsbereiche zu verbessern.

- Optimierte Versionen versenden, um zusätzliche manuelle oder KI-unterstützte forensische Prüfungen zu erhalten.

- Kopien der Originaldateien separat aufbewahren.

Dies ist ein organisierter Ansatz, der die Untersuchung unterstützt, ohne Beweise zu zerstören.

Teil 6: Best Practices mit Deepfake-Identitätserkennungstools und KI-Verbesserung

Deepfake erfordert einen mehrschichtigen Ansatz, um effektiv geschützt zu werden.

1. Quellen verifizieren

Original-Upload-Konten, Metadaten, Verteilungsmuster usw. Unzuverlässige Hintergründe deuten häufig auf Manipulation hin.

2. Multi-Faktor-Authentifizierung verbessern

Video-Bestätigung sollte niemals die alleinige Grundlage für finanzielle oder rechtliche Entscheidungen sein. Biometrische Authentifizierung mit Sicherheitskanälen kombinieren.

3. KI-Tools kombinieren

Verbesserungstools und spezialisierte Deepfake-Detektoren einsetzen. Die Tools bearbeiten verschiedene Analyseebenen.

4. Strukturierte Prüfprozesse implementieren

Organisationen sollten:

- Originaldateien bewahren.

- Kopien für Analysen anfertigen.

- Prüfschritte dokumentieren.

- verbesserte Frames neben Originalen aufbewahren.

- Ergebnisse objektiv dokumentieren.

5. Informiert bleiben

Die Erkennungskompetenz wird durch Verständnis der häufigsten Manipulationstechniken wie Gesichtsmischung oder synthetischer Stimmenschichtung verbessert.

Menschen und Unternehmen sollten davon ausgehen, dass verdächtige Videos möglicherweise manipuliert sind, bis das Gegenteil bewiesen ist. Skepsis ist der einzige Weg – eine ausgewogene Skepsis, die vor Irreführung schützt, ohne Überreaktionen zu verursachen.

FAQs zur Deepfake-Identitätserkennung

Deepfake-Identitätserkennung bezeichnet das Verfahren zur Untersuchung digitaler Inhalte, um festzustellen, ob eine Person ihr Aussehen oder ihre Stimme künstlich mit KI verändert hat. Dabei werden visuelle Diskrepanzen, Zeitmuster und Metadaten analysiert, anstatt sich nur auf einen einzelnen visuellen Eindruck zu verlassen.

Ja. KI-basierte Erkennungsmodelle prüfen anhand von Statistiken, Mikroexpressionen, Gesichtslandmarken und weiteren Merkmalen das Vorhandensein synthetischer Manipulationen. Diese Systeme sind meist effektiver als menschliche Prüfer; allerdings sind sie nicht fehlerfrei und sollten mit organisierten Kontrollen kombiniert werden.

Videoverbesserung erhöht die Tiefenschärfe und Schärfe von Videos, wodurch subtile Anomalien leichter überprüfbar sind. Sie kategorisiert Videos nicht als echt oder gefälscht, unterstützt jedoch sowohl manuelle Analysen als auch spezielle Erkennungssoftware, da Details aufgedeckt werden, die durch Unschärfe oder Kompression verdeckt sind.

Schutzmaßnahmen umfassen die Überprüfung der Inhaltsquellen, Nutzung von Multi-Faktor-Authentifizierung, Schulung von Mitarbeitern, Aufbewahrung der Originalmedien und Integration von KI-Optimierung mit spezieller Deepfake-Erkennungssoftware.

Fazit

Im Zeitalter hochentwickelter KI-generierter Medien ist Deepfake-Identitätserkennung keine Option mehr, sondern Notwendigkeit. Da synthetische Gesichtstausch- und Stimmklonmethoden immer realistischer werden, sollten Organisationen und Personen proaktive Verifizierungsmaßnahmen ergreifen. Ein ausgewogener Ansatz in der Erkennung ist notwendig: Manipulationsmethoden erkennen, Prüfprozesse organisieren und KI-basierte Analysetools einsetzen. Videoverbesserungsprozesse wie HitPaw VikPea können die Klarheit schärfen, Details im Gesicht wiederherstellen und kleine Unstimmigkeiten offenlegen, um eine gründlichere forensische Untersuchung zu ermöglichen.

Kommentar hinterlassen

Bewertung zu HitPaw-Artikeln erstellen