DeepSeek V4: Was man von MODEL1, Engram und Sparse FP8 erwarten kann

DeepSeek V4 verspricht einen großen Fortschritt für große Modelle durch die Kombination von Langzeit-Kontext-Fähigkeiten, kostengünstigerer Inferenz und erinnerungsähnlichem Abruf. Frühe Leaks und technische Berichte deuten auf vier Kernfortschritte hin – einen gestuften KV-Cache (MODEL1), sparsames FP8-Mischpräzisions-Decoding, ein Engram-Speichermodul für Langzeiterinnerungen und mHC-optimierte Residuen für schnelleres Training. Zusammen machen diese lange, mehrteilige Code- und Mehrsessions-Agenten deutlich praktikabler.

Teil 1. DeepSeek V4: Was sind die Highlights?

DeepSeek V4 zielt darauf ab, wirklich langzeitige KI mit einem 1-Million-Token-Fenster freizuschalten, einem gestuften MODEL1-KV-Cache für Host-Speicher-Auslagerung, sparsamen FP8-Decoding für schnellere Inferenz, einer Engram-Langzeitgedächtnisschicht und mHC-Residualen, die das Training beschleunigen und die Stabilität erhöhen. Diese Änderungen zielen auf Leistung, Skalierung und niedrigere Kosten ab.

- 1.1 Million Token Kontextfenster – V4 hebt die Kontextgrenzen von Zehntausenden auf etwa eine Million Token an, was die Analyse ganzer Codebasen oder riesiger Dokumente ermöglicht.

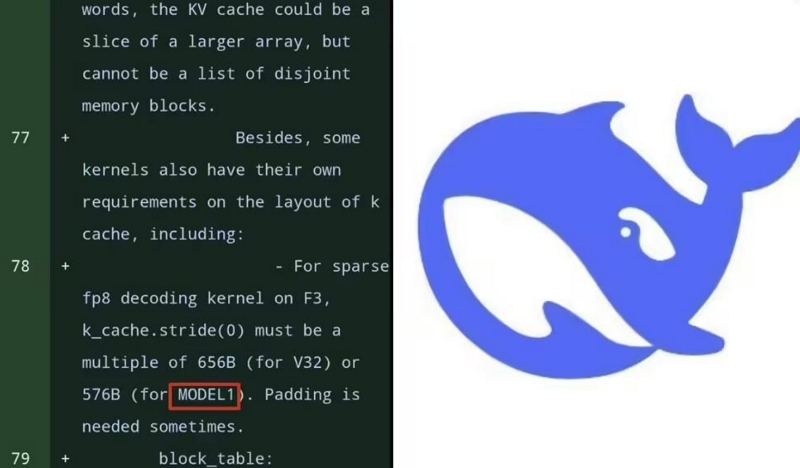

- 2.MODEL1 gestufter KV-Cache – Eine Speicherhierarchie platziert die heißesten KV-Daten auf der GPU, mittelhäufige KV im RAM und archivierte KV auf der Festplatte, wodurch der GPU-Speicherbedarf gesenkt und der Kontext erweitert wird.

- 3.Sparsames FP8-Decoding (Mischpräzision) – Selektive Präzision verwendet FP16 für kritische Tokens und FP8 für andere, was große Geschwindigkeitssteigerungen bei minimalem Qualitätsverlust bringt.

- 4.Engram-Speichermodul – Ein vektorunterstütztes Langzeitgedächtnis trennt vorübergehenden Kontext von dauerhaften Erinnerungen (Präferenzen, Designentscheidungen, Projektverlauf) für personalisierte Mehrsessions-Agenten.

- 5.mHC-optimierte Residualverbindungen – Erlernbare schichtweise Residualskalierung ermöglicht schnellere Konvergenz, sanfteres Training und moderate Qualitätssteigerungen.

- 6.Multimodale native Unterstützung und Hardwareoptimierung – V4 ist für multimodale Eingaben konzipiert und für eine Vielzahl von Inferenz-Hardware abgestimmt.

- 7.Ökosystem & strategischer Kontext – Die Veröffentlichung wird im Rahmen eines größeren KI-Wettlaufs beobachtet, der Fragen zu Governance, Sicherheit und internationaler Zusammenarbeit aufwirft.

Teil 2. DeepSeek V4: Was kann die neue Architektur?

Die Architektur von DeepSeek V4 überdenkt Inferenz und Gedächtnis: MODEL1 reduziert den GPU-Speicherdruck durch Auslagerung der meisten KV-Zustände in RAM und Festplatte, sparsames FP8 beschleunigt das Decoding durch niedrigere Präzision bei weniger kritischen Tokens, Engram liefert abrufbares Langzeitgedächtnis, und mHC-Residuale beschleunigen das Training und stabilisieren das Lernen. Zusammen machen diese Änderungen lange, zustandsbehaftete Agenten in großem Maßstab erschwinglich.

MODEL1-Architektur – gestufter KV-Cache und warum er wichtig ist

Das Problem: Traditionelle KV-Caches skalieren linear mit der Token-Historie und erschöpfen schnell den GPU-VRAM bei Langzeitsessions.

MODEL1s Lösung: Heißeste KV-Paare werden auf GPU-VRAM gelegt, mittelhäufige KV in CPU-RAM und historische KV auf Festplatte. Diese Auslagerung kann den GPU-Speicherbedarf drastisch senken, praktische Kontextfenster über bisherige harte Grenzen hinaus erweitern und Kosten im Vergleich zur ausschließlichen GPU-Nutzung reduzieren. Reale Anwendungsfälle umfassen vollständige Repositorium-Code-Reviews, riesige Dokumentenanalysen und kohärente Mehrsessions-Assistenten.

Sparsames FP8-Decoding – Mischpräzisions-Intelligenz

Die Erkenntnis: Nur ein Teil der Tokens beeinflusst stark die Berechnung des nächsten Tokens. Durch schnelle Bewertung der Token-Wichtigkeit rechnet das Modell kritische Tokens in höherer Präzision und den Rest in FP8.

Ergebnisse: Deutlich höhere FP8-Abdeckung, nahezu Verdoppelung des Inferenz-Durchsatzes bei minimalem Genauigkeitsverlust – ein wichtiger Kostentreiber für hochvolumige Dienste.

Engram-Speichermodul – über Kontextfenster hinaus

Kontext vs. Gedächtnis: V4 trennt flüchtigen Arbeitskontext von kuratierten Langzeiterinnerungen, die in einer Vektordatenbank gespeichert sind.

Wie es hilft: Anstatt ganze Historien erneut zu verarbeiten, extrahieren Systeme markante Fakten und speichern diese, um nur das Relevante abzurufen – was persistente Assistenten ermöglicht, die Präferenzen, Projektentscheidungen und frühere Lösungen erinnern.

mHC-optimierte Residuale – intelligentere Trainingsdynamik

Was sich ändert: Residualverbindungen erhalten erlernbare Skalierungsfaktoren pro Schicht, sodass das Netzwerk Schichtbeiträge betonen oder herabsetzen kann.

Vorteile: Schnelleres Training, sanftere Konvergenz und messbare Qualitätsverbesserung bei geringerem Rechenaufwand.

Teil 3. Wann kommt DeepSeek V4?

Frühe Signale und Berichte deuten darauf hin, dass DeepSeek eine V4-Ankündigung um die erste Märzwoche 2026 plant, wobei mehrere Medien und Community-Threads auf ein Veröffentlichungsfenster in derselben Woche wie das Laternenfest, 3. März 2026, hindeuten. Bis zu einer offiziellen Stellungnahme bleibt Unsicherheit, sodass Beobachter mit einer Ankündigung oder gestaffelten Einführung an jedem Tag dieses Zeitfensters rechnen.

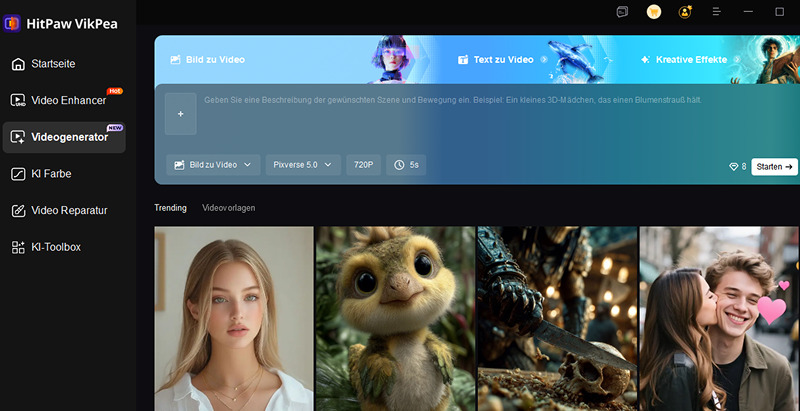

Bonus-Tipps. Erstellen Sie beeindruckende KI-Videos mit HitPaw VikPea AI Video Generator

Wenn Sie eine praktische, desktopfreundliche Möglichkeit suchen, moderne generative Workflows zu testen, während Sie auf Modell-News warten, HitPaw VikPea bietet Text-zu-Video- und Bild-zu-Video-Generierung sowie leistungsstarke Enhancement-Tools. VikPea kombiniert mehrere kreative Modelle, einfache Voreinstellungen und Frame-Level-Enhancement, sodass Kreative kurze Clips erstellen, Bilder in Bewegung verwandeln oder Aufnahmen vor der Veröffentlichung veredeln können. Es ist eine pragmatische Wahl für Kreative, die schnelle, hochwertige visuelle Ergebnisse ohne tiefgehende ML-Expertise benötigen.

- KI-Videoerstellung aus Text oder Bildern für schnelle kreative Videoproduktion.

- Mehrere KI-Modelle, optimiert für verschiedene Stile und ästhetische Richtungen.

- Anpassbare Auflösungs- und Dauer-Einstellungen zur Kontrolle der finalen Videolänge und -größe.

- Integrierte Enhancement-Pipeline verbessert Klarheit, Farbe, Schärfe und Rauschunterdrückung.

- Benutzerfreundliche Oberfläche für schnelle Ergebnisse ohne technische Expertise.

- Batch-Verarbeitung und Formatunterstützung für professionelle Workflows und große Dateien.

Schritt 1.Installieren und öffnen Sie VikPea unter Windows oder Mac und wählen Sie dann das AI Video Generator Tool im Hauptmenü.

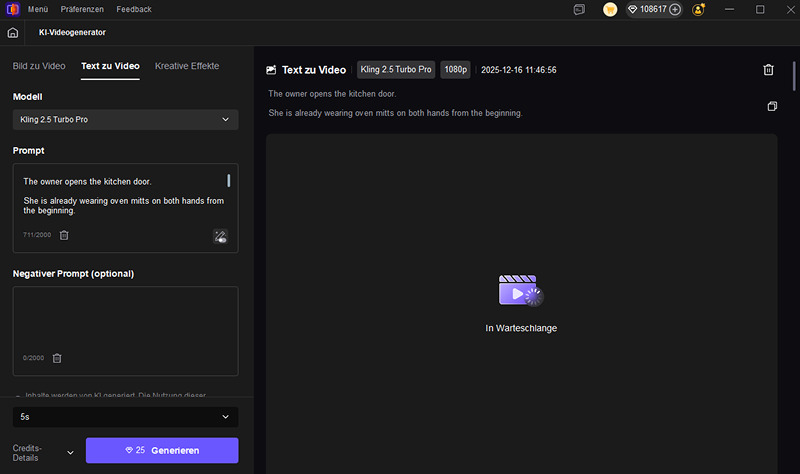

Schritt 2.Geben Sie einen Textprompt ein oder laden Sie Bilder hoch: Wählen Sie Text-zu-Video für promptgesteuerte Clips oder Bild-zu-Video für framebasierte Bewegungen.

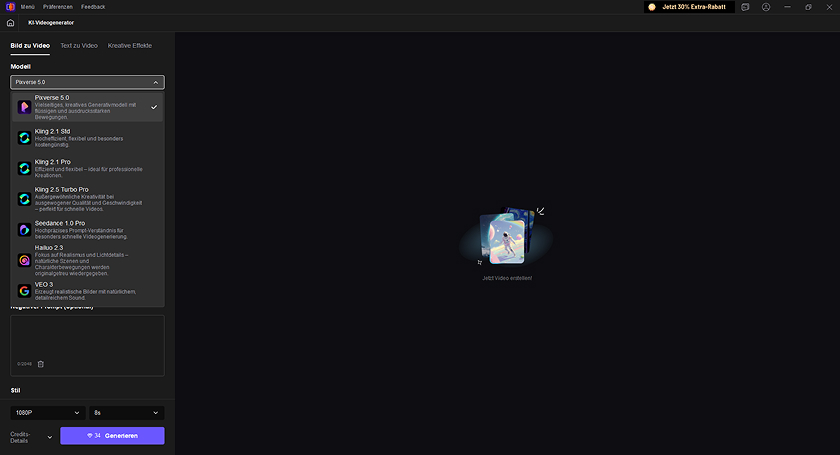

Schritt 3.Wählen Sie ein Modell und passen Sie Ausgabeeinstellungen wie Dauer, Auflösung und Stilsteuerungen an.

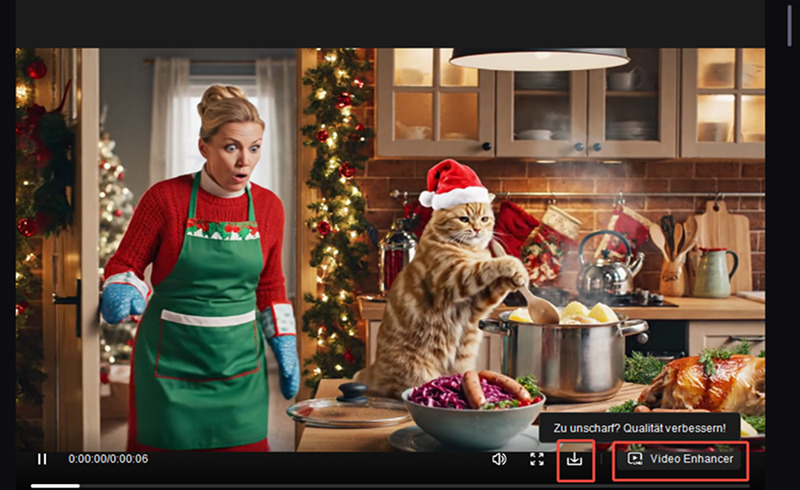

Schritt 4.Klicken Sie auf Generieren, sehen Sie die Vorschau an, speichern Sie das Ergebnis oder verwenden Sie den integrierten Enhancer für den finalen Feinschliff.

Teil 5. Häufig gestellte Fragen zu DeepSeek V4

Frühe Leaks und Benchmarks deuten darauf hin, dass V4 für Codierung und lange Repositorien-Reasoning optimiert ist, aber bis unabhängige, peer-reviewed Vergleiche veröffentlicht werden, ist es verfrüht, es als das endgültig beste Codierungsmodell zu bezeichnen. Starke Verbesserungen im Codebase-Reasoning sind zu erwarten, doch das „beste“ Modell hängt von Aufgabe, Latenz und Sicherheitskompromissen ab.

Reddit-Threads kombinieren Leak-Aggregation, Entwickler-Tests und Community-Hype, während Leser Code-Diffs, MODEL1-Referenzen und Testläufe analysieren. Eine Mischung aus glaubwürdigen Repo-Signalen und Spekulationen befeuert die lebhafte Diskussion.

Aktualisieren Sie Toolchains zur Unterstützung von Host-Speicher-Auslagerung, erforschen Sie Vektorspeichermuster, testen Sie Mischpräzisions-Inferenz und planen Sie Evaluierungssuiten für Langzeit-Kontextaufgaben. Stellen Sie außerdem sicher, dass Governance-Checks und Sicherheitsprüfungsprozesse für neue Fähigkeiten bereitstehen.

Fazit

DeepSeek V4 wirkt wie eine wegweisende technische Veröffentlichung, die praktische Skalierung priorisiert: deutlich längere Kontexte, günstigere Inferenz und persistente Erinnerungen, die Agenten eher zu Teammitgliedern als zu flüchtigen Werkzeugen machen. Während die endgültige Verifizierung auf die offizielle Veröffentlichung und unabhängige Benchmarks wartet, sind die architektonischen Ideen – MODEL1-Gestufung, sparsames FP8-Decoding, Engram-Gedächtnis und mHC-Residuale – konkrete Hebel, um lange, personalisierte KI nützlich und erschwinglich zu machen. Behalten Sie das offizielle Ankündigungsfenster im Auge und führen Sie frühe Integrationstests mit Tools wie HitPaw VikPea durch, wenn Sie heute multimodale kreative Workflows ausprobieren möchten.

Kommentar hinterlassen

Bewertung zu HitPaw-Artikeln erstellen