KI Video Workflow: GPT Image 2.0 & Seedance 2.0 Guide

Die Weiterentwicklung der generativen KI hat das digitale Storytelling von statischen Konzepten in kinoreife Realitäten verwandelt. Die Beherrschung des KI-Video-Workflows von GPT Image 2.0 zu Seedance 2.0 markiert den Höhepunkt der modernen Content-Erstellung. Durch die Kombination der Prompt-Intelligenz von GPT mit der temporalen Stabilität von Seedance 2.0 können Creator hochqualitative Videos mit hervorragender visueller Konsistenz produzieren. Dieser Leitfaden zeigt, wie Sie die Lücke zwischen KI-Bildgenerierung und professioneller Videosynthese schließen, um Ergebnisse zu erzielen, die früher nur mit hohem Budget in Studios möglich waren.

Teil 1. Was ist der GPT Image 2.0 zu Seedance 2.0 KI-Video-Workflow?

Der GPT Image 2.0 zu Seedance 2.0 KI-Video-Workflow ist eine professionelle Produktionspipeline, die fortschrittliche Sprachmodelle nutzt, um hochauflösende Keyframes zu gestalten, die anschließend von einer spezialisierten Video-Diffusions-Engine animiert werden. Dieser zweistufige Prozess gewährleistet, dass das Video den spezifischen künstlerischen Stil, Charakterdetails und die Umgebungsbeleuchtung des Ausgangsbilds beibehält.

Wie GPT Image 2.0 und Seedance 2.0 KI zusammenarbeiten

- Konzept-Architektur: GPT Image 2.0 fungiert als Regisseur und wandelt komplexe natürliche Sprachprompts in hyperrealistische, kompositorisch perfekte Basisbilder um.

- Temporale Animation: Seedance 2.0 übernimmt das statische Ergebnis von GPT und wendet physikalische Bewegungen an, um realistische Bewegungen über die Zeit zu simulieren.

- Visuelle Kontinuität: Der Workflow verwendet das GPT-Bild als „Wahrheitsquelle“, um Morphing- oder Flackereffekte zu vermeiden, die bei einfachen KI-Videos häufig auftreten.

- Präzise Kontrolle: Creator können das Bilddesign iterativ verfeinern, bevor sie in die rechenintensivere Videorendering-Phase wechseln.

- Semantische Abstimmung: Das fortgeschrittene Verständnis von GPT Image 2.0 sorgt dafür, dass visuelle Elemente perfekt zur narrativen Tiefe des finalen Videos passen.

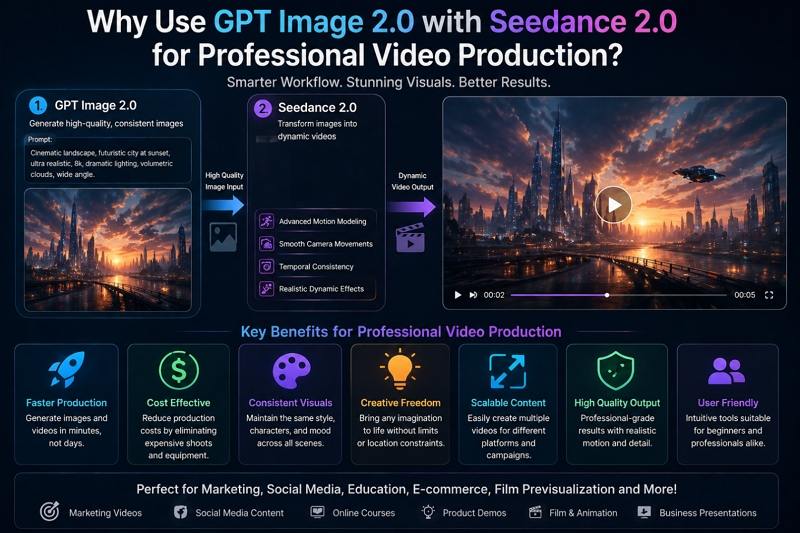

Teil 2. Warum GPT Image 2.0 mit Seedance 2.0 für professionelle Videoproduktion nutzen?

Die Nutzung von GPT Image 2.0 zusammen mit Seedance 2.0 für die professionelle Videoproduktion bietet unvergleichliche Kontrolle über Charakterkonsistenz und Umgebungsdetails. Diese spezielle Kombination reduziert die Unvorhersehbarkeit herkömmlicher Text-to-Video-Modelle durch einen hochqualitativen visuellen Anker und liefert flackerfreie, studiotaugliche Animationen für kommerzielle Nutzung und hochwertiges Marketing.

- Verbesserte Charakterstabilität: Durch den Start mit einem hochwertigen GPT-Bild bleiben Gesichtszüge und Kleidung des Charakters während des gesamten Videoclips konsistent.

- Kinoähnliche Lichtsteuerung: GPT Image 2.0 ermöglicht präzise Beleuchtungsszenarien, die Seedance 2.0 mit realistischen Schatten und Reflexionen animiert.

- Reduzierte Artefakte: Die Seed-Lock-Technologie in Version 2.0 minimiert den „Schmelz-Effekt“ und erhält die strukturelle Integrität von Objekten bei Bewegungen.

- Kosten- und Zeiteffizienz: Dieser Workflow erlaubt die Freigabe eines „Keyframes“ zuerst und vermeidet teure mehrmalige Videorenderings.

- Professionelle Auflösung: Die Synergie dieser Tools unterstützt hochauflösende Ausgaben, die den technischen Anforderungen moderner Social-Media- und Broadcast-Plattformen entsprechen.

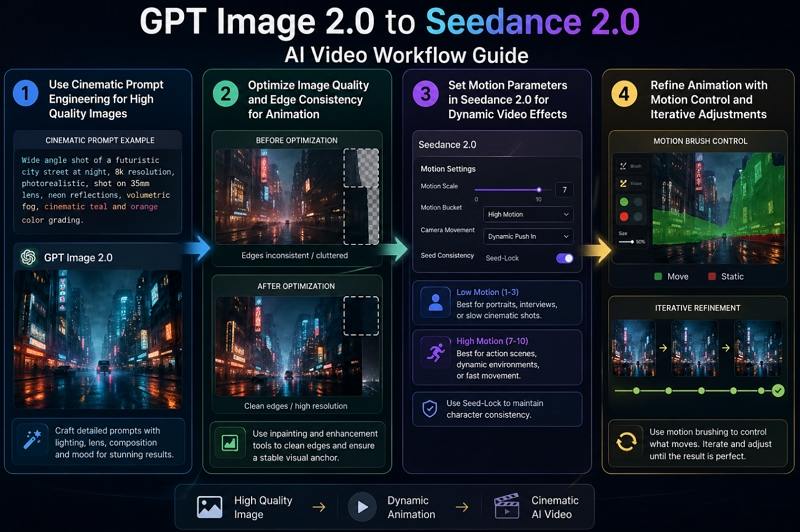

Teil 3. So nutzen Sie GPT Image 2.0 und Seedance 2.0 für die KI-Videoproduktion

Um GPT Image 2.0 und Seedance 2.0 für die KI-Videoproduktion zu verwenden, erstellen Sie zunächst ein detailliertes Basisbild in GPT mit kinematografischem Prompt-Engineering. Sobald das Bild verfeinert ist, importieren Sie es in einen Videogenerator, der das Seedance 2.0-Modell unterstützt, und stellen Motion-Parameter ein, um das statische Bild zum Leben zu erwecken.

Schritt 1: Kinematografische Prompts in GPT Image 2.0 erstellen

Die Videoqualität hängt stark vom Ausgangsbild ab. Bei der Nutzung von GPT Image 2.0 konzentrieren Sie sich auf detaillierte kinematografische Prompts, die Beleuchtung, Objektivtyp, Komposition und Stimmung einbeziehen. Vermeiden Sie generische Beschreibungen und bauen Sie stattdessen reichen visuellen Kontext auf.

Beispiel-Prompt-Struktur:

Weitwinkelaufnahme einer futuristischen Stadtstraße bei Nacht, 8K-Auflösung, photorealistisch, mit 35mm-Objektiv, Neon-Reflexionen, volumetrischem Nebel, kinematografischem Color Grading

Dieses Detailniveau erzeugt visuell überzeugende Frames als starke Grundlage für die Animation.

Schritt 2: Den visuellen Anker für die Animation verfeinern

Nach der Bildgenerierung verfeinern Sie es vor dem Weitergehen. Nutzen Sie Inpainting-Tools, um Kanten zu bereinigen, Inkonsistenzen zu beheben und wichtige Bereiche zu verbessern. Das Ziel ist ein stabiler visueller Anker.

Seedance 2.0 verlässt sich auf Bildgrenzen, um Bewegungen außerhalb des Frames vorherzusagen. Saubere Kanten und hochauflösende Eingaben sorgen für flüssigere Kamerabewegungen und realistischere Animationsergebnisse.

Schritt 3: Motion-Parameter in Seedance 2.0 einstellen

Laden Sie Ihr verfeinertes Bild in Seedance 2.0 hoch und konfigurieren Sie die Bewegungs-Einstellungen sorgfältig. Diese Parameter definieren, wie Ihr statisches Bild zur bewegten Szene wird.

- Niedrige Motion-Level eignen sich ideal für Porträts, Interviews oder langsame kinematografische Aufnahmen.

- Hohe Motion-Level funktionieren am besten bei Action-Szenen, dynamischen Umgebungen oder schnellen Bewegungen.

- Nutzen Sie Seed-Consistency-Funktionen, um die Charakteridentität zu erhalten und visuelle Verzerrungen zu vermeiden.

Die Balance der Bewegungsintensität ist entscheidend für natürliche und fesselnde Ergebnisse.

Schritt 4: Bewegung steuern und Ausgabe verfeinern

Nach der ersten Animation verfeinern Sie sie mit fortschrittlichen Tools wie Motion Brushing. So kontrollieren Sie, welche Bildteile sich bewegen und welche statisch bleiben.

Sie können beispielsweise Wolken animieren, während Gebäude still bleiben, oder subtile Umgebungsbewegungen erzeugen, ohne das Hauptsubjekt zu beeinflussen. Diese selektive Steuerung steigert den Realismus und verleiht Ihrem Video einen professionellen Schliff.

Iteration ist essenziell. Passen Sie Prompts, Motion-Einstellungen und Verfeinerungen an, bis das Endergebnis Ihrer kreativen Vision entspricht.

Teil 4. Optimieren Sie Ihren Workflow mit HitPaw VikPea Seedance 2.0 Video Generator

Für Creator, die diesen komplexen Prozess vereinfachen möchten, bietet HitPaw VikPea eine robuste und intuitive Umgebung, die speziell für die neuesten KI-Modelle optimiert ist. HitPaw VikPea ist eine umfassende KI-Video-Lösung, die den Übergang von statischen Assets zu dynamischem Kino vereinfacht. Es integriert Top-Modelle wie Seedance 2.0 in eine einheitliche Oberfläche, sodass sowohl Einsteiger als auch Profis hochwertigen Content ohne tiefgehende technische Kenntnisse in Machine Learning erstellen können. Erfahren Sie mehr auf HitPaw.

- KI-Video-Generierung aus Text oder Bildern für kreative Videoproduktion

- Mehrere KI-Modelle inklusive Kling, VEO3 und Seedance 2.0 für vielfältige Videostile

- Anpassbare Auflösung und Dauer-Einstellungen für flexible Ausgabekontrolle

- Integrierte Enhancement-Tools verbessern Klarheit, Schärfe und visuelle Konsistenz

- Schneller Rendering-Engine für effiziente Content-Produktion

- Einfache Oberfläche für Einsteiger und Fortgeschrittene gleichermaßen

-

Schritt 1.Installieren und starten Sie HitPaw VikPea auf Ihrem Windows- oder Mac-Computer und wählen Sie den AI Video Generator im Dashboard.

-

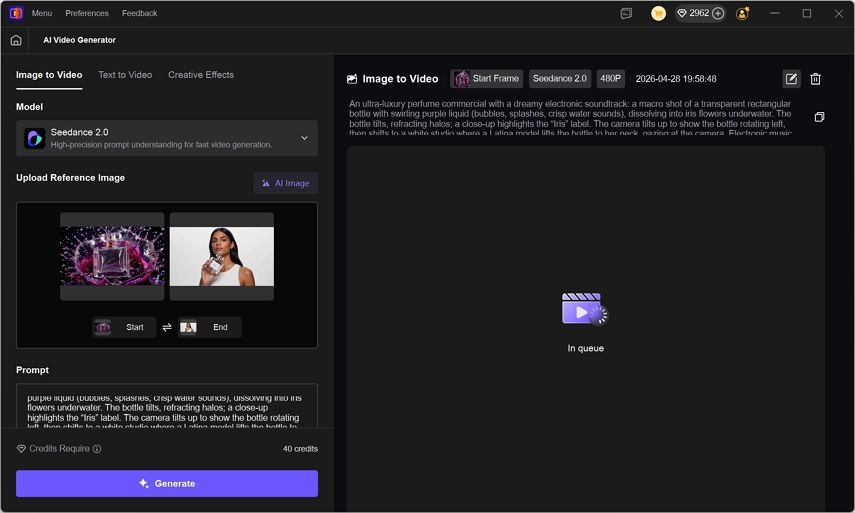

Schritt 2.Wählen Sie das Seedance 2.0-Modell für Ihr Projekt. Wählen Sie den Image-to-Video-Modus und laden Sie das zuvor mit GPT Image 2.0 erstellte Charakterbild hoch. Konfigurieren Sie die Ausgabeeinstellungen mit gewünschter Videodauer und Auflösung.

-

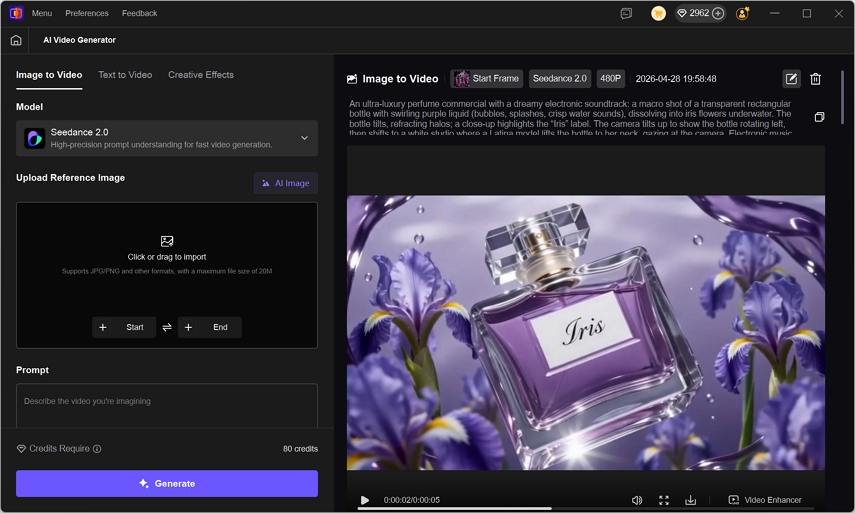

Schritt 3.Klicken Sie auf „Generate“, um den KI-Rendering-Prozess zu starten. Nach Abschluss können Sie das Video previewen, herunterladen oder mit dem Video Enhancer Tool die Klarheit verbessern.

Teil 5. Best Practices für den GPT Image 2.0 zu Seedance 2.0 Workflow

Die besten Praktiken für einen GPT Image 2.0 zu Seedance 2.0 Workflow umfassen die Verwendung von kontrastreichen Bildern und klaren Fokuspunkten, damit die KI Bewegungsregionen besser erkennt. Die konsequente Nutzung detaillierter beschreibender Keywords für Bildgenerierung und Videomotion-Prompts sorgt für höchste stilistische Übereinstimmung.

- Einfache Hintergründe verwenden: Vermeiden Sie zu überladene Hintergründe in GPT Image 2.0, damit Seedance 2.0 sich besser auf die Animation des Hauptsubjekts konzentrieren kann.

- Bewegung zum Subjekt anpassen: Niedrigere Motion-Skalen für Porträts und höhere für Natur- oder Action-Szenen, um Realismus zu wahren.

- Iterative Verfeinerung: Bei Abweichungen das Ausgangs-GPT-Bild mit deutlicheren Kanten und klarerer Beleuchtung anpassen.

- Prompt-Synchronisation: Videomotion-Prompts kurz und direkt halten und spezifische zu bewegende Elemente referenzieren.

- Auflösungsabstimmung: GPT-Bilder im gleichen Seitenverhältnis wie das geplante Video generieren, um unerwünschtes Zuschneiden oder Strecken zu vermeiden.

FAQs zum GPT Image 2.0 zu Seedance 2.0 Workflow

Der Hauptvorteil des GPT Image 2.0 zu Seedance 2.0 Workflows ist die Effizienz. Dieser Workflow ermöglicht es, schnell Visuals zu generieren und in Videos umzuwandeln, ohne traditionelle Produktionsschritte – Zeit und Kosten sparen bei gleichzeitig hoher Qualität.

Ja, Einsteiger können diese Tools mit grundlegender Anleitung leicht nutzen. Der Prozess umfasst einfache Schritte wie Prompts schreiben und Bilder arrangieren – zugänglich auch ohne professionelle Video-Editing-Erfahrung.

Der GPT Image 2.0 zu Seedance 2.0 Workflow eignet sich derzeit am besten für hochwertige kurze Clips, die später zusammengeschnitten werden können. Durch die Erstellung mehrerer Segmente mit denselben GPT Image 2.0 Charakter-Assets lässt sich ausreichend Konsistenz erzielen, um eine zusammenhängende und professionelle Langform-Geschichte aufzubauen.

Mit dem GPT Image 2.0 zu Seedance 2.0 Workflow können Sie Marketing-Videos, Bildungsinhalte, Storytelling-Videos, Social-Media-Clips und vieles mehr erstellen. Die Flexibilität der KI-Tools ermöglicht eine breite Palette kreativer Anwendungen.

Fazit

Die Beherrschung von KI-Video-Workflows mit GPT Image 2.0 und Seedance 2.0 verschafft in der heutigen contentgetriebenen Welt einen entscheidenden Vorteil. Durch die Kombination intelligenter Bildgenerierung mit automatisierter Videoproduktion erstellen Creator fesselnde Videos schneller und effizienter. Mit dem richtigen Workflow und Tools wie HitPaw VikPea kann jeder Ideen in überzeugende visuelle Inhalte verwandeln und im sich wandelnden digitalen Umfeld wettbewerbsfähig bleiben.

Kommentar hinterlassen

Bewertung zu HitPaw-Artikeln erstellen