DaVinci-MagiHuman Review: Funktionen, Leistung & KI-Videoerstellung

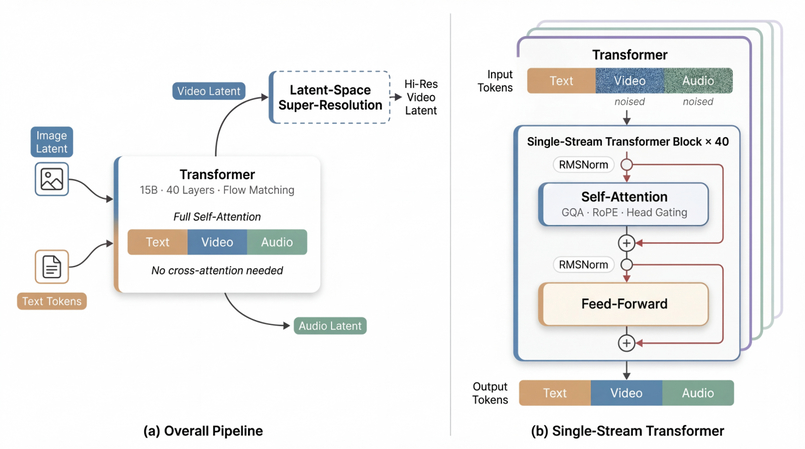

DaVinci-MagiHuman ist ein fortschrittliches Open-Source-KI-Videomodell zur Video- und Audioerzeugung aus Text in einer einzigen zusammenhängenden Pipeline. Anstatt Audio und Video wie die meisten KI-Videotools als zwei separate Ausgaben zu generieren, synthetisiert DaVinci-MagiHuman Audio und visuelle Elemente gemeinsam in einer Transformer-Struktur und liefert menschenzentrierte Ergebnisse mit natürlicher Lippen-Synchronisation, emotionaler Gesichtsdarstellung und lebensechter Bewegung.

Das Modell ist in sechs Sprachen verfügbar: Englisch, Chinesisch, Japanisch, Koreanisch, Deutsch, Französisch, und läuft mit einer Geschwindigkeit, die iterative Inhaltserstellung ermöglicht. So sollte es wirklich sein! Diese Rezension behandelt die Architektur, Benchmarks, praktische Anwendungen und rundet alles mit HitPaw VikPea ab, um professionelle, elegante, soziale oder kommerzielle Ergebnisse zu erzielen.

Teil 1: DaVinci-MagiHuman Schlüsselfunktionen, die es revolutionär machen

Übersicht

DaVinci-MagiHuman bietet eine Reihe von Funktionen, die weit über inkrementelle Verbesserungen der aktuell verfügbaren KI-Videotools hinausgehen.

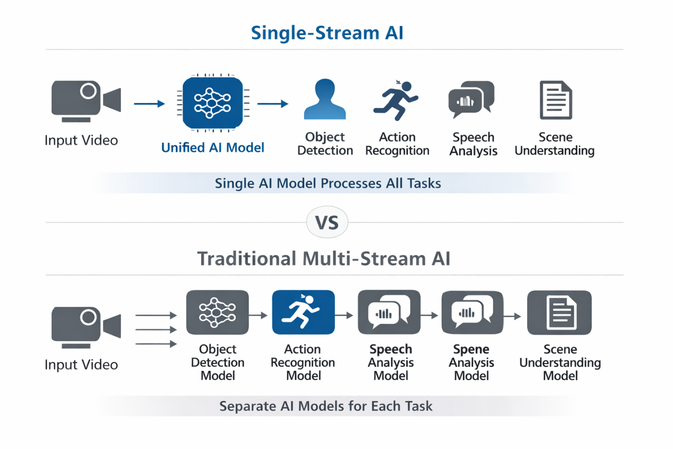

Es verwendet einen Single-Stream-Transformer, im Gegensatz zu den meisten Konkurrenten, die Multi-Stream-Lösungen verwenden. Anstatt Video und Audio separat zu verarbeiten und dann zu kombinieren, verarbeitet DaVinci-MagiHuman Text-, Video- und Audiotoken gleichzeitig – was eine perfekte Synchronisation von Sprache und Lippenbewegungen sowie kohärente Gestik ohne die Notwendigkeit der Verschmelzung separater Ausgaben ermöglicht.

Top-Funktionen von DaVinci-MagiHuman

- Unified Transformer: Text, Video und Audio werden in einem einzigen Self-Attention-Stream verarbeitet (keine komplexe Cross-Attention).

- Menschenzentrierte Ausgabe: Erstellt realistische Avatare mit natürlichen Ausdrücken und hochwertiger Audio-Video-Synchronisation.

- Hohe Inferenzgeschwindigkeit: Erzeugt ein 5 Sekunden langes 1080p-Video in ca. 38 Sekunden mit einer zweistufigen Pipeline (niedrige Auflösung → verfeinert).

- Sprachen: Unterstützt Englisch, Chinesisch, Japanisch, Koreanisch, Deutsch und Französisch.

- Open Source: Alles ist im Quellcode enthalten (Basis, Destillation, Superauflösung und Codebasis).

- Hohe Erfolgsquote: Übertrifft die Konkurrenz mit bis zu 80 % Erfolg in menschlichen Bewertungen.

Das ist nicht überraschend, da das Modell speziell auf menschenzentrierte Qualität abgestimmt wurde: ausdrucksstarke Gesichter, natürliche Sprachlieferung und realistische Körperbewegungen. Die mehrsprachige Funktionalität für alle 6 Sprachen ist im Basismodell integriert und kein Add-on, sodass Aussprache und Lippen-Synchronisation über alle Sprachen hinweg konsistent sind.

Und die Leistung auf einer einzelnen H100 ist sehr gut – ein 5-Sekunden-256p-Video benötigt 2 Sekunden, 540p 8 Sekunden, 1080p 38 Sekunden.

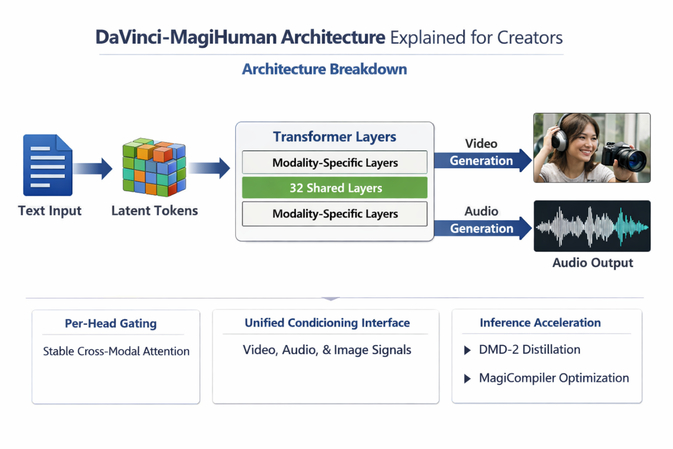

Teil 2: DaVinci-MagiHuman Architektur erklärt für Kreative

Architekturübersicht

Das Verständnis der Architektur gibt Ihnen einen besseren Einblick in die Nutzung des Modells. DaVinci-MagiHuman verwendet ein Sandwich-Design: Die ersten und letzten 4 Transformer-Schichten sind modalitiespezifisch (Video, Audio und Text werden unabhängig verarbeitet), die mittleren 32 Schichten werden vollständig von allen Modalitäten gemeinsam genutzt. Dies ermöglicht dem Modell, tiefe modalübergreifende Verbindungen zu erfassen und gleichzeitig die spezifischen Eigenschaften jeder Ausgabetype beizubehalten.

Anstatt explizite Zeitstempel-Signale zur Steuerung der Rauschunterdrückung zu verwenden – wie bei herkömmlichen Diffusionsmodellen – sagt DaVinci-MagiHuman die Richtung der Rauschunterdrückung aus den Eingabe-Latents selbst voraus. Per-Kopf-Gating stabilisiert die Aufmerksamkeit zwischen Modalitäten und verhindert unerwünschte Instabilitäten, wenn Video- und Audiotoken durch dieselben gemeinsamen Schichten verarbeitet werden. Eine gemeinsame Konditionierungs-Schnittstelle empfängt Video-, Audio- und Referenzbildsignale als eine minimalistische Schnittstelle, was sowohl die Inferenz als auch das Feintuning erleichtert.

Zwei weitere Methoden beschleunigen die Inferenz: DMD-2-Destillation reduziert die Anzahl der Rauschunterdrückungsschritte, und MagiCompiler führt hardwareoptimierte Operator-Level-Optimierungen durch. Zusammen ermöglichen sie 1080p-Renderings unter 40 Sekunden auf H100-Hardware.

Teil 3: DaVinci-MagiHuman Leistung & Benchmarks, denen Sie vertrauen können

Benchmark-Ergebnisse

Die Benchmark-Ergebnisse von DaVinci-MagiHuman sind in allen Aspekten herausragend. In Tests zur menschlichen Präferenz hat es eine Gewinnrate von 80 % gegenüber OVI 1.1 und 60,9 % gegenüber LTX 2.3 – echte Menschen sind durchweg zufriedener mit den Ausgaben. Die Wortfehlerrate (WER) von 14,6 % ist niedriger als bei beiden Konkurrenten, was zu verständlicherer und textgenauer Sprache führt.

| Metrik | DaVinci-MagiHuman | OVI 1.1 | LTX 2.3 |

|---|---|---|---|

| Menschliche Gewinnrate | 80 % / 60,9 % | Basislinie | Basislinie |

| Wortfehlerrate | 14,6 % | Höher | Höher |

| 256p Geschwindigkeit | 2 Sek. | Langsamer | Langsamer |

| 1080p Geschwindigkeit | 38 Sek. | Langsamer | Langsamer |

| Integriertes Audio | Ja | Nein | Nein |

| Open Source | Ja | Teilweise | Nein |

Hinweis: Geschwindigkeitsbenchmarks wurden auf einer einzelnen NVIDIA H100 GPU gemessen.

Das Gesamtbild ist beeindruckend: DaVinci-MagiHuman ist sowohl schneller als auch qualitativ besser als die nächstgelegenen Open-Source-Alternativen. Für Content-Ersteller bedeutet das mehr Iterationen pro Stunde und weniger Nachbearbeitungen, bevor Inhalte veröffentlicht werden können.

Teil 4: DaVinci-MagiHuman praktische Anwendungen – reale Anwendungsfälle

Anwendungsfälle

DaVinci-MagiHuman eignet sich für eine Reihe praktischer künstlerischer und geschäftlicher Anwendungsfälle:

- Generiertes Storytelling: Erstellen Sie Kurzfilme oder animierte Videotagebücher mit ausdrucksstarken KI-Menschen.

Beispielprompt: "Eine Frau Anfang dreißig spricht in einem gemütlichen Café zur Kamera: 'Ich hätte nie gedacht, dass sich diese Stadt wie Zuhause anfühlen würde, aber hier bin ich.'" - Inhaltslokalisierung: Erstellen Sie dasselbe Video in verschiedenen Sprachen mit nur einem Modell. Sechs-Sprachen-Kampagnen, die früher sechs separate Drehs erforderten, sind jetzt sechs Text-Prompts.

- Schnelles Prototyping: Führen Sie mehrere Werbeskripte/Konzepte an einem Nachmittag durch. Mit 2 Sekunden pro 256p-Render ist die Iteration schnell.

Beispielprompt: "Ein begeisterter Profi: 'Unsere Plattform geht nicht nur darum, Ihnen Zeit zu sparen – es verändert, wie Ihr Team zusammenarbeitet.'" - Digitale Avatare und KI-Moderator:innen: Erstellen Sie wiederverwendbare KI-Sprecher-Personas für Schulungsvideos, Produktdemos oder interne Kommunikation – kein Termin, kein Nachdrehen.

Was Sie mit MagiHuman erstellen können

- Digitale Avatare und virtuelle Moderator:innen

- Content-Lokalisierung im großen Maßstab

- Interaktive Unterhaltung

- Marketing und Werbung

- Podcast- und Videoinhalte

Benutzer müssen nicht vor der Kamera erscheinen und alles zum Hochladen vorbereiten. Verbesserungen sind auch nötig, um Videos zu polieren und professionelle Qualität zu erreichen.

Hinweis: Ausgabe in voller Auflösung erfordert H100-Klasse GPU-Hardware. Cloud-Dienste wie RunPod, Vast.ai oder Google Colab Pro bieten bequeme Optionen für Künstler ohne leistungsstarke lokale GPUs.

Teil 5: Verbessern Sie Ihre DaVinci-MagiHuman-Videos mit HitPaw VikPea

Warum Verbesserung wichtig ist

DaVinci-MagiHuman liefert erstaunliche Ergebnisse, aber KI-basierte Videos weisen üblicherweise einige Artefakte auf – geringfügiges Verwischen oder Rauschen an Kanten, Banding oder Farbinkonsistenzen –, die bei kommerzieller oder professioneller Nutzung durch Nachbearbeitung bereinigt werden können. Dies sind subtile Unvollkommenheiten, die die wahrgenommene Videoqualität beeinflussen können, besonders bei Betrachtung auf kundenorientierten oder hochauflösenden Formaten, weshalb die Verbesserung ein wichtiger letzter Schritt im Videoprozess ist.

Was kann HitPaw VikPea für Sie tun?

HitPaw VikPea ist ein KI-Video-Upscaler-Tool, das genau für diesen Zweck entwickelt wurde, mit den besten Upscaling-, Entrauschungs- und Detailwiederherstellungsmodellen zur Verarbeitung von KI-generierten Videos. Es kann Gesichtszüge verbessern, Farbton korrigieren und Kompressionsartefakte entfernen, sodass Sie rohe Ergebnisse in saubere und hochauflösende Bilder verwandeln können. Kombinieren Sie die Modularität der Open-Source-KI-Erzeugung mit dem professionellen Finish kommerzieller Verbesserung, und Sie erhalten polierte, veröffentlichungsbereite Ausgaben, die sich für soziale Medien, Marketingkampagnen oder Kundenprojekte eignen.

Hauptfunktionen von HitPaw VikPea

- KI-Super-Resolution-Technologie: Es verstärkt das DaVinci-MagiHuman-Video auf 4K Ultra HD bei Erhalt von Details und lebendigen Farben.

- KI-Bildzwischenbildberechnung: Verbessert die Bildrate für flüssigere und weichere Bewegungen in Kino und Animation.

- KI-Entrauschungs-Engine: Beseitigt unerwünschtes Rauschen und stellt Schärfe für ein saubereres und professionelleres Ergebnis wieder her.

- Farbkorrektur & HDR-Abstimmung: Kontrast, Helligkeit und Farbsättigung werden an den einzigartigen DaVinci-MagiHuman-Videostil angepasst.

- Batch-Video-Upscaling-Modus & Formatunterstützung: Auto Enhance Video ermöglicht die gleichzeitige Verbesserung mehrerer Videos, sodass keine Zeit für Einzelvideoverbesserung verschwendet wird. Unterstützt eine breite Palette von Formaten (MP4, MOV, AVI, MKV).

- Benutzerfreundlich & plattformübergreifend: Ein einfach zu bedienendes Programm, kompatibel mit Windows und macOS..

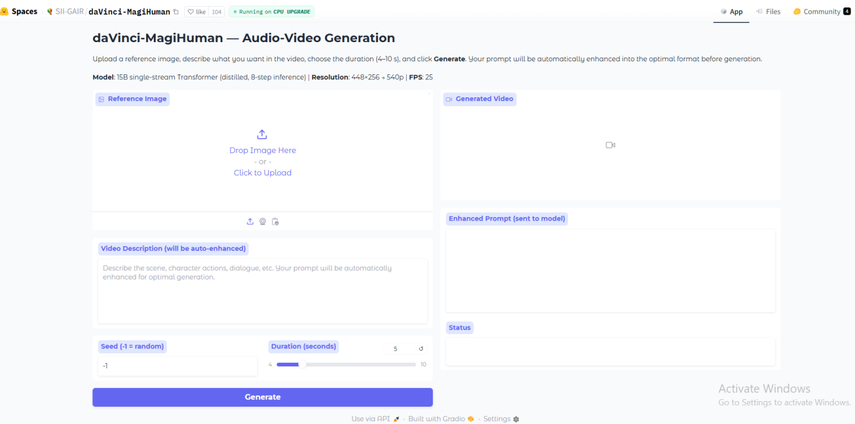

Schritte zur Verbesserung von DaVinci-MagiHuman-Videos mit HitPaw VikPea

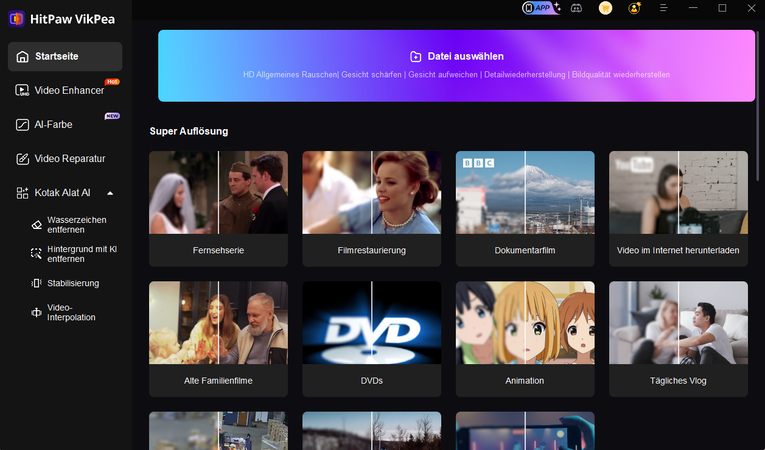

Schritt 1: Installation und Download

Besuchen Sie die offizielle Webseite und laden Sie HitPaw VikPea herunter. Nach der Installation starten Sie die Anwendung und melden sich bei Bedarf an.

Schritt 2: Importieren Sie Ihr Material in den Video Enhancer

Klicken Sie im linken Panel, um das Video Enhancer-Modul zu öffnen. Drücken Sie das Symbol, um Ihre internationale Frauen-Tags-Film-/Clip-/Videodatei in die Oberfläche zu importieren.

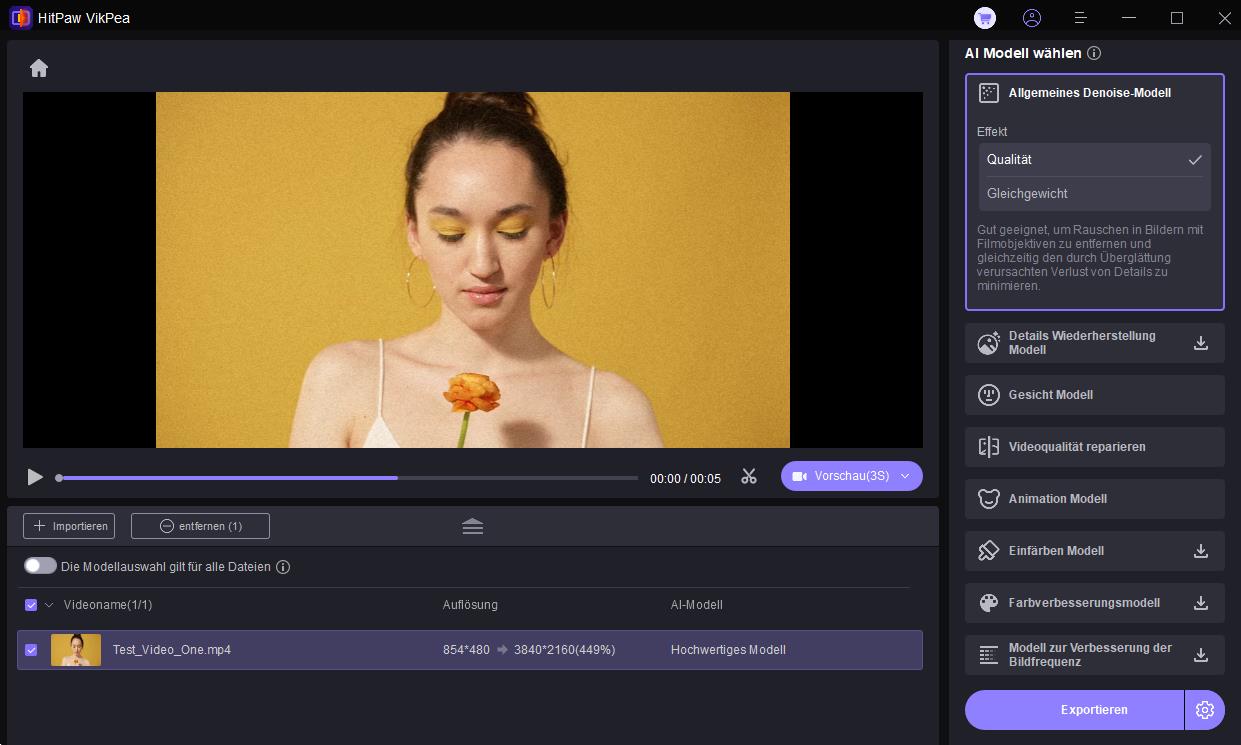

Schritt 3: Verwenden Sie das passende KI-Modell

Neben einem allgemeinen Modell, das die Verbesserung insgesamt anwendet, gibt es mehrere spezialisierte Modelle, die je nach besonderem Verbesserungsbedarf auf das Video angewendet werden können.

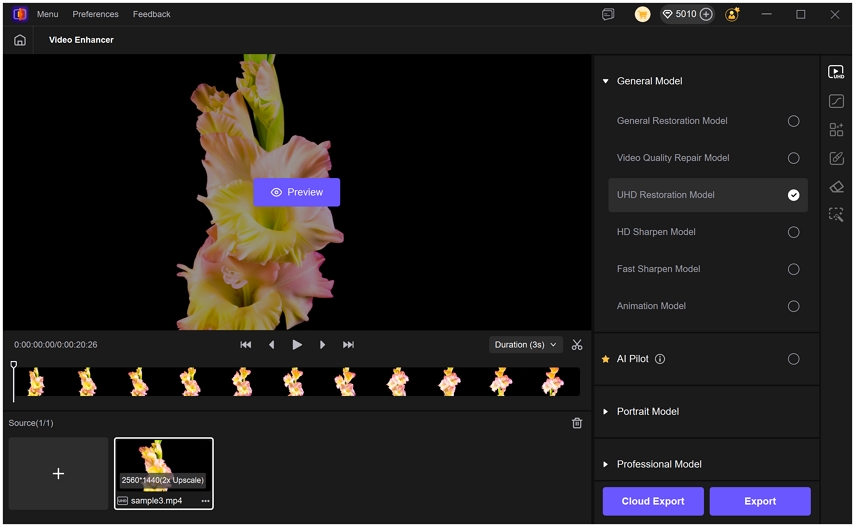

Sie können weitere Modelle wie das UHD Restoration Model anwenden, das die Videoqualität eines hochauflösenden 720p-Videos weiter verbessert, die Sichtbarkeit erhöht und die Schärfe wiederherstellt.

Wählen Sie die Vorschau-Länge (3 oder 5 Sekunden). Falls Sie nur einige Elemente des Videos verbessern möchten, verwenden Sie das Schnittwerkzeug. Legen Sie die Ausgaberauflösung und das Format fest.

Tipps: Wenn Sie unsicher sind, welches Modell Sie verwenden sollen, nutzen Sie AI Pilot. Es prüft Ihr Video automatisch und empfiehlt die passendste Verbesserung.

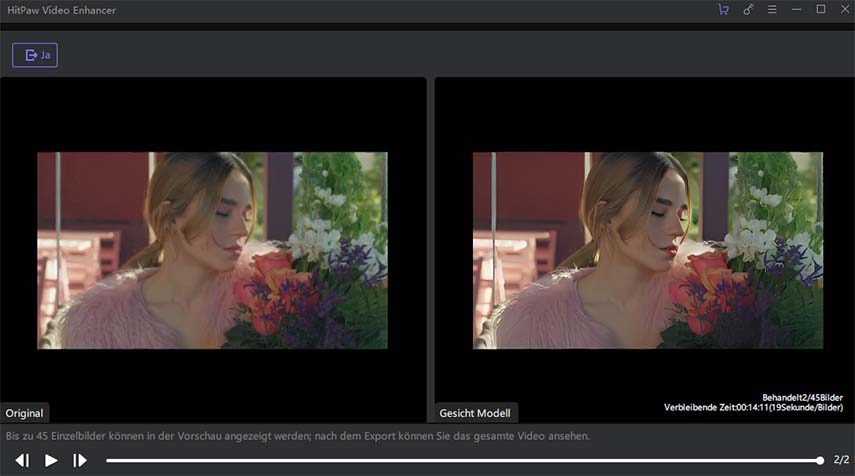

Schritt 4: Vorschau und Speichern

Nachdem Sie alle notwendigen Anpassungen vorgenommen haben, klicken Sie auf Vorschau, um die Vorher-Nachher-Ergebnisse Ihres Videos zu vergleichen. So sehen Sie klar den Unterschied zwischen Original und verbesserter Version, bevor Sie endgültig speichern.

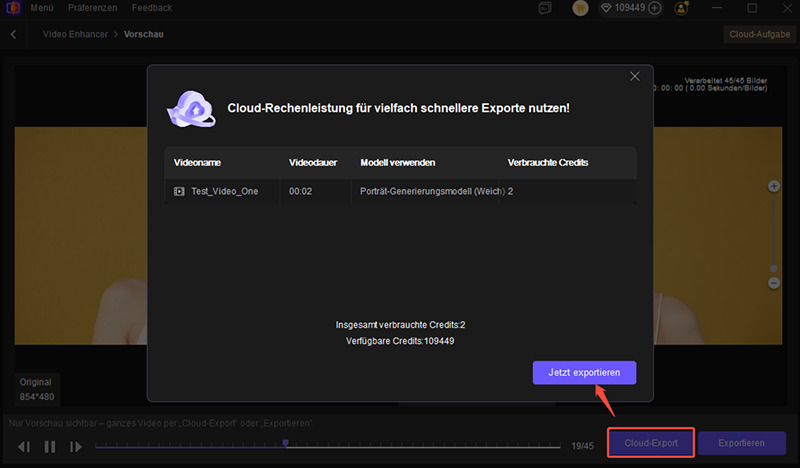

Schritt 5: Export oder Cloud-Export

Sobald Sie mit der Vorschau zufrieden sind, wählen Sie Export oder Cloud Export, um Ihr Video zu speichern. Genießen Sie verbesserte Videos mit beeindruckender Klarheit.

FAQs zu DaVinci-MagiHuman

Ja, es ist komplett Open Source ohne Lizenzierungsaufwand. Sie benötigen jedoch NVIDIA H100-Hardware, um 1080p auszuführen. Wer keine lokale GPU hat, kann auf Cloud-Dienste wie RunPod oder Vast.ai zugreifen, die Kosten für die Berechnung verursachen. Niedrigauflösende (256p) Ausgaben können auf weniger leistungsstarker Hardware ausgeführt werden.

Einige grundlegende Terminalbefehle sind hilfreich beim Einrichten und Ausführen eines Inferenz-Skripts, aber Sie müssen kein vollwertiger Programmierer sein. Die Open-Source-Community entwickelt benutzerfreundlichere Wrapper. Für Nicht-Programmierer bieten cloud-gehostete Demos den schnellsten Weg.

Ja. DaVinci-MagiHuman unterstützt nativ Englisch, Chinesisch, Japanisch, Koreanisch, Deutsch und Französisch mit korrekter Aussprache und Lippen-Synchronisation in jeder Sprache, was es zu einer der besten Open-Source-Lösungen für mehrsprachige Content-Produktion macht.

Fazit

DaVinci-MagiHuman ist eine wirklich bahnbrechende Open-Source-KI-Videolösung des Jahres 2026. Sein integriertes Audio-Video-Design, die mehrsprachige, menschennahe Ausgabequalität und die schnelle Inferenz ebnen den Weg für Open-Source-KI-Videoproduktion.

Die Kombination von DaVinci-MagiHuman mit HitPaw VikPea schließt die Lücke zwischen KI-generiertem und professionell perfektioniertem Video. Erstellen Sie ausdrucksstarke und zeitlich abgestimmte mehrsprachige Inhalte mit DaVinci-MagiHuman und verarbeiten Sie die Ausgaben anschließend mit HitPaw VikPea zum Upscaling, Entrauschen und Verbessern von Gesichtern. Die Kombination liefert professionelle Ergebnisse für einen Bruchteil der Kosten traditioneller Produktionen.

Kommentar hinterlassen

Bewertung zu HitPaw-Artikeln erstellen