HappyHorse-1.0 vs Seedance 2.0: Lohnt der Hype?

Als KI-Tool-Rezensent habe ich dutzende Videogenerierungsmodelle getestet – aber nur wenige haben die Landschaft so schnell verändert wie HappyHorse-1.0 und Seedance 2.0. Der Bereich ist nicht mehr experimentell; es ist ein vollwertiger Wettbewerb um die Vorherrschaft. Seedance 2.0 setzte mit seiner multimodalen Stärke den Maßstab, aber jetzt erhebt HappyHorse-1.0 kühne Ansprüche als „Seedance-Killer“. Nach praktischen Tests und Benchmark-Analysen stellt sich eine Frage: Ist HappyHorse-1.0 wirklich besser oder nur Hype?

Teil 1: Was sind HappyHorse-1.0 und Seedance 2.0?

Aus meiner Testerfahrung repräsentieren HappyHorse-1.0 und Seedance 2.0 zwei sehr unterschiedliche Richtungen in der KI-Videogenerierung.

HappyHorse-1.0 Übersicht

HappyHorse-1.0 fühlt sich wie ein Modell an, das für Kreative gebaut wurde, die vor allem Wert auf visuelle Qualität legen. In meinen Tests lieferte es durchgehend cinematischere Ergebnisse mit flüssigerer Bewegung und weniger Artefakten im Vergleich zu den meisten Konkurrenten. Es unterstützt sowohl Text-zu-Video- als auch Bild-zu-Video-Workflows, aber was wirklich heraussticht, ist seine zeitliche Konsistenz – Videos wirken stabil, mit minimalem „KI-Flackern“.

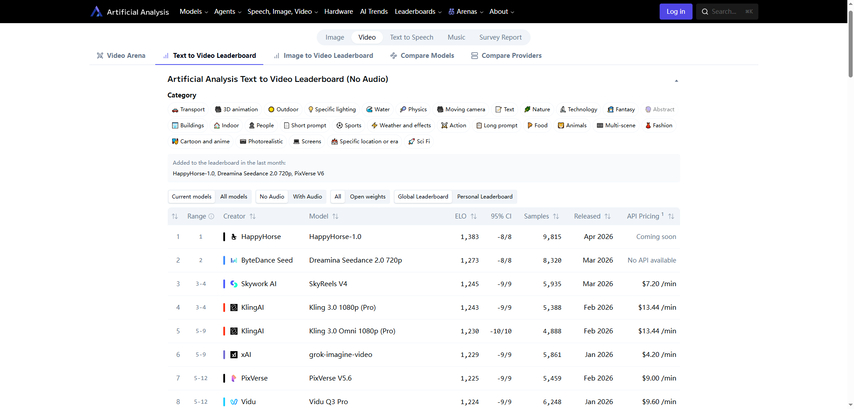

Zu den wichtigsten Stärken, die ich beobachtet habe, gehören starke Charakterkonsistenz (Gesichter und Identitäten verändern sich kaum) und eine deutlich schnellere Renderpipeline. Benchmark-technisch wurde HappyHorse-1.0 an der Spitze von Elo-basierten Bewertungen wie AI Video Arena eingestuft, was mit meiner subjektiven Erfahrung übereinstimmt: Es sieht in vielen Fällen einfach besser aus.

Seedance 2.0 Übersicht

Seedance 2.0ist hingegen ein Feature-Powerhouse. Entwickelt mit klarem Fokus auf multimodale Generierung, unterstützt es Text-, Bild-, Videoeingaben – und sogar native Audioerzeugung. Das macht es wesentlich flexibler für komplexe Projekte.

In der Praxis fand ich, dass Seedance bei Kamerasteuerung und Multi-Shot-Komposition glänzt. Man kann Sequenzen generieren, die näher an realer Filmproduktion sind, mit Schwenks, Zooms und Szenenübergängen. Es ist auch eines der meistdiskutierten KI-Videomodelle, vor allem wegen seiner Realitätsnähe und Vielseitigkeit.

Wer hat HappyHorse-1.0 entwickelt? (Spekulative Einsicht)

Einer der Gründe, warum HappyHorse-1.0 so viel Aufmerksamkeit erregt hat, ist gerade seine mysteriöse Herkunft. Je weniger Klarheit besteht, desto mehr Neugierde weckt es – und natürlich hat der Markt begonnen, eigene Theorien zu bilden.

Die am weitesten verbreitete Spekulation verweist auf eine Verbindung zum Future Life Laboratory unter der Taotian Group (Alibaba-Ökosystem), möglicherweise unter Leitung von Zhang Di. Nach öffentlich verfügbaren Hintergrundinformationen spielte Zhang Di zuvor eine Schlüsselrolle im Kling-KI-Videoprojekt bei Kuaishou und war davor verantwortlich für großskalige Daten- und Machine-Learning-Infrastruktur in Alibabas Werbeabteilung.

Diese Theorie hat in der Branche und in Selbstmedien an Fahrt aufgenommen, hauptsächlich weil die technische Ausrichtung von HappyHorse-1.0 – insbesondere seine Stärke bei Bewegungsrealismus und großskaligem Modellieren – Fähigkeiten ähnelt, die man in führenden chinesischen KI-Labors sieht.

Es ist jedoch wichtig, aus professioneller Bewertungsperspektive klarzustellen: Es gibt derzeit keine offizielle Bestätigung oder autoritative Quelle, die diese Behauptung verifiziert.

Teil 2: HappyHorse-1.0 vs Seedance 2.0 (Vollständige Vergleichstabelle)

Nach Tests beider Modelle und Durchsicht der Benchmark-Daten wird der Unterschied zwischen HappyHorse-1.0 und Seedance 2.0 viel klarer, wenn man ihn über Kernbereiche hinweg analysiert. Statt eines einfachen „Wer ist besser?“ zeigt dieser Vergleich, wo jedes Modell tatsächlich führend ist.

| Kategorie | HappyHorse-1.0 | Seedance 2.0 |

|---|---|---|

| T2V Qualität (ohne Audio) | Rang #1 (~1330+ Elo), stärkste visuelle Konsistenz | Rang #2 (~1270+ Elo), leicht hinter Seedance bei Bewegungsstabilität |

| T2V Qualität (mit Audio) | Etwas niedriger eingestuft, Audio weniger ausgereift | Top-Leistung mit besserer Audio-Video-Synchronisation |

| I2V Qualität (ohne Audio) | Führende Leistung (~1390+ Elo), exzellente Eingabeaufforderungsübereinstimmung | Sehr stark (~1350+ Elo), aber leicht weniger stabil |

| I2V Qualität (mit Audio) | Wettbewerbsfähig, aber nicht führend | Leicht vorne mit strengerer Synchronisation |

| Audioerzeugung | Verfügbar, aber nicht Kernstärke | Fortschrittliche native Audio mit Dual-Branch-Synchronisation |

| Modellarchitektur | Einzelstrom-Großtransformator (Fokus auf einheitliche Generierung) | Dual-Branch Diffusion + Transformer-Hybrid (Video- + Audio-Trennung) |

| Bewegung & Physik | Natürlicher, weniger Flackern, stärkere zeitliche Kohärenz | Hochrealistisch, aber gelegentliche Instabilität in komplexen Szenen |

| Eingabeaufforderungstreue | Sehr stark, besonders bei cinematischen Prompts | Stark, aber abhängig von multimodalen Eingaben |

| Bekannter Anbieter | Nicht offiziell bekanntgegeben (spekulativ) | Entwickelt von ByteDance |

| Offene Gewichte | Behauptet kommend (noch nicht vollständig verfügbar) | Nicht Open-Source |

| API-Verfügbarkeit | Noch keine öffentliche API | Begrenzter Zugang (Verbrauchertools verfügbar, offizielle API eingeschränkt) |

| Zugangskanäle | Hauptsächlich Demo-/Webzugang | Verfügbar über Plattformen wie Dreamina und CapCut (regional beschränkt) |

| Benutzerfreundlichkeit | Einfacher, mehr output-fokussiert | Komplexer, aber sehr flexibel |

| Beste Einsatzbereiche | Hochwertige cinematische Clips, Werbung, visuelles Storytelling | Erweiterte Workflows, Filmproduktion, multimodale Projekte |

Wichtigste Erkenntnisse aus dem Vergleich

Aus Sicht eines Rezensenten ist der Unterschied sehr klar:

- HappyHorse-1.0 führt bei visuellen Qualitätsbenchmarks

- Seedance 2.0 führt bei multimodalen Fähigkeiten

- Architektur erklärt die Lücke

→ Besonders bei Text-zu-Video und Bild-zu-Video ohne Audio, wo Bewegungs-Konsistenz und Realismus am wichtigsten sind

→ Besonders wenn Audio, Kamerasteuerung und komplexe Szenenkomposition involviert sind

→ HappyHorse’s einheitlicher Transformer begünstigt Konsistenz

→ Seedance’s Dual-Branch-System begünstigt Flexibilität und Synchronisation

Teil 3: Vorteile von HappyHorse-1.0

Aus meinen praktischen Tests und Benchmark-Analysen sticht HappyHorse-1.0 als ein Qualitätsmodell hervor, das visuelle Exzellenz über Funktionskomplexität stellt.

- Beste Bewegungsrealismusklasse

- Top-Benchmark-Leistung (besonders ohne Audio)

- Schneller Produktionsworkflow

- Mehrsprachige Unterstützung

Der auffälligste Vorteil ist seine zeitliche Konsistenz. Bewegungen wirken natürlich mit deutlich reduziertem Flimmern, Verzerrungen oder „KI-Flackern“ – ein häufiges Problem bei vielen Videomodellen.

In Elo-basierten Bewertungen (wie AI Video Arena) belegt HappyHorse konstant Platz 1 bei Text-zu-Video- und Bild-zu-Video-Aufgaben ohne Audio, was eine starke menschliche Präferenz für seine visuellen Ausgaben zeigt.

Im Vergleich zu komplexeren multimodalen Systemen generiert HappyHorse schneller Ergebnisse und benötigt weniger Anpassungen – was es effizient für schnelle Inhaltserstellung macht.

Es bewältigt Lippen-Synchronisationen in mehreren Sprachen effektiv, was für globale Kreative und Marketingteams wertvoll ist.

Am besten geeignet für:

- Werbekreative

- Cinematisches Storytelling

- Produkt-Showcase-Videos

Teil 4: Vorteile von Seedance 2.0

Im Gegensatz dazu ist Seedance 2.0 als multimodales Kreativsystem gebaut, das mehr Kontrolle und Flexibilität bietet statt reiner visueller Dominanz.

- Native Audio- + Videogenerierung

- Starke multimodale Fähigkeiten

- Fortschrittliche Kamerasteuerung

- Flexible kreative Workflows

- Öffentlicher Zugang über Ökosystemtools

Einer seiner größten Differenzierer ist die integrierte Audio-Video-Synchronisation, die die Erzeugung von Szenen mit Dialog, Soundeffekten oder Umgebungsgeräuschen ermöglicht.

Seedance unterstützt Text-, Bild-, Video- und Audioeingaben, wodurch Nutzer die Ausgaben viel präziser steuern können.

Es bietet cinematische Steuerungen wie Schwenk, Zoom, Tracking und Multi-Shot-Komposition, was die Ergebnisse näher an echte Filmproduktionen bringt.

Seedance verhält sich eher wie ein KI-Regie-Tool, geeignet zum Aufbau strukturierter Erzählungen statt einzelner Clips.

Obwohl nicht vollständig offen, ist es über Plattformen wie Dreamina und CapCut (regionabhängig) zugänglich, was Nutzern praktische Experimentiermöglichkeiten bietet.

Am besten geeignet für:

- Filmemacher und fortgeschrittene Kreative

- Mehr-Szenen-Erzählungen

- Komplexe, strukturierte Videoprojekte

Teil 5: Einschränkungen von HappyHorse-1.0 und Seedance 2.0

Obwohl beide Modelle hochmodern sind, sind sie nicht ohne Kompromisse.

Einschränkungen von HappyHorse-1.0

- Begrenzte Transparenz des Ökosystems

- Schwächere multimodale Fähigkeiten

- Frühphasige Plattform

Das Team und die Roadmap sind noch unklar, was Fragen zur langfristigen Unterstützung und Stabilität aufwirft.

Im Vergleich zu Seedance bietet es weniger Kontrolle über Audio, Kamerabewegung und komplexe Szenenkomposition.

Der Zugang ist noch limitiert (hauptsächlich Demo-basiert), mit keiner weit verbreiteten API oder ausgereiftem Ökosystem.

Einschränkungen von Seedance 2.0

- Begrenzte globale Verfügbarkeit

- Höhere Komplexität

- Potenzielle Inhaltsbeschränkungen

Der Zugang ist größtenteils auf bestimmte Regionen oder Plattformen beschränkt, was für internationale Nutzer ein Hindernis sein kann.

Seine mächtigen Funktionen gehen mit einer steileren Lernkurve einher, was es für Anfänger weniger geeignet macht.

Wie viele großskalige KI-Systeme könnte es strengere Moderation durchsetzen, die bestimmte kreative Nutzungen einschränkt.

Teil 6: HappyHorse-1.0 vs Seedance 2.0: Zukunft der KI-Videomodelle

Aus Branchenberichten und eigenen Tests geht klar hervor, dass die KI-Videogenerierung sich von „beeindruckenden Demos“ hin zu Produktionsinfrastruktur entwickelt. Im Jahr 2026 ist der größte Wandel, dass diese Modelle keine isolierten Tools mehr sind – sie werden zu End-to-End-Kreativsystemen.

Erstens beschleunigt sich die multimodale Konvergenz. Führende Modelle sind jetzt in der Lage, Video, Audio und sogar narrative Strukturen in einer einzigen Pipeline zu generieren, was den Bedarf an separaten Tools reduziert. Genau dorthin steuern Modelle wie Seedance, und dort wird sich wahrscheinlich auch HappyHorse weiterentwickeln.

Zweitens nähert sich die Qualität den Produktionsstandards der realen Welt an. Wir sehen native 4K-Ausgaben, längere Clips und deutlich bessere Physiksimulation, wobei KI-generierte Videos in kommerziellen Workflows nutzbar werden. In manchen Fällen hat KI die Produktionszeit bereits von Tagen auf Minuten reduziert.

Drittens entsteht Echtzeit- und interaktive Videogenerierung. Forschungen zeigen, dass neue Architekturen die Latenz dramatisch reduzieren und auf Live-Generierung und interaktive KI-gesteuerte Szenen statt vorgerenderter Clips zusteuern.

Schließlich verschiebt sich die Branche hin zu KI-Filmmach-Engines – Systemen, die Skripting, Generierung, Schnitt und Distribution an einem Ort abwickeln. Die Akzeptanz wächst schnell, über 40 % der kreativen Teams in Unternehmen integrieren KI-Video bereits in ihre Workflows.

Mein Fazit: Die nächste Generation von Modellen wird nicht nur „Qualität vs Kontrolle“ konkurrieren – sie wird beides kombinieren und KI-Video von einem Tool zu einer zentralen Kreativplattform machen.

Bonus-Tipp – Probieren Sie mehrere KI-Videomodelle in einem Desktop-Tool aus

Wenn Sie nicht an ein einzelnes KI-Modell gebunden sein wollen, ist die Verwendung einer Desktop-Plattform, die mehrere Videogenerierungs-Engines integriert, ein viel schlauerer Workflow – gerade in einem sich so schnell entwickelnden Bereich.

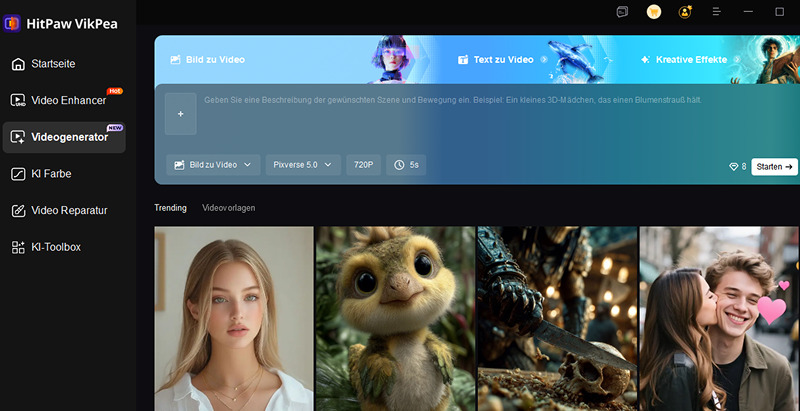

Aus meiner Erfahrung, HitPaw VikPea ist eine praktische Wahl, da es Ihnen ermöglicht, mehrere KI-Videomodelle direkt auf Ihrem PC zu nutzen und zu testen. Anstatt zwischen verschiedenen Online-Tools zu wechseln oder mit Zugangsbeschränkungen zu kämpfen, können Sie in einer stabilen Umgebung experimentieren, vergleichen und Ergebnisse verfeinern.

Warum empfohlen:

- Unterstützt mehrere führende KI-Modelle (einschließlich Kling, Seedance, Pixverse und mehr)

- Desktop-basierter Workflow für bessere Stabilität und Leistung

- Keine Abhängigkeit von Browser-Limits oder instabilem Webzugang

- Unterstützt sowohl Text-zu-Video als auch Bild-zu-Video-Generierung

- Integrierte Videoverbesserungstools für Nachbearbeitung (Upscaling, Rauschreduzierung, Farbkorrektur)

Am besten geeignet für:

- Kreative, die volle Kontrolle über Generierung und Ausgabequalität wollen

- Nutzer, die mehrere KI-Modelle testen ohne Plattformwechsel

- Professionelle, die einen stabilen, reproduzierbaren Videoproduktionsworkflow benötigen

FAQs zu HappyHorse-1.0 vs Seedance 2.0

F1. Ist HappyHorse-1.0 besser als Seedance 2.0?

A1. Im Vergleich HappyHorse-1.0 vs Seedance 2.0 gibt es keinen universellen Sieger – es hängt vom Anwendungsfall ab. HappyHorse-1.0 führt generell bei visueller Qualität, Bewegungsrealismus und Benchmark-Rankings (besonders ohne Audio), während Seedance 2.0 bei multimodaler Generierung, Audio-Video-Synchronisation und kreativer Kontrolle punktet. Für cinematische Visuals gewinnt oft HappyHorse; für komplexe Workflows ist Seedance mächtiger.

F2. Kann ich heute über API auf HappyHorse-1.0 zugreifen?

A2. Derzeit bietet HappyHorse-1.0 keine öffentlich verfügbare API an. Die meisten Nutzer können es nur über Demo-Plattformen oder eingeschränkte Webschnittstellen nutzen. Es gibt Hinweise darauf, dass API- oder Open-Weight-Veröffentlichungen in der Zukunft kommen könnten, aber kein offizieller Zeitplan wurde bestätigt. Für Entwickler bedeutet das, dass es aktuell nicht produktionsreif für Integrationen ist, anders als ausgereiftere Ökosysteme.

F3. Welche Hardware wird benötigt, um HappyHorse-1.0 zu betreiben?

A3. Um HappyHorse-1.0 lokal zu betreiben, wäre High-End-Hardware erforderlich, typischerweise Multi-GPU-Setups (z. B. A100/H100-Level GPUs) aufgrund der großskaligen Videogenerierungsarchitektur. Da es aber noch nicht vollständig Open-Source ist, interagieren die meisten Nutzer über Cloud- oder Demo-Zugang. Praktisch benötigen Sie keine lokale Hardware, es sei denn, die vollständigen Modellgewichte werden veröffentlicht, was die Hürde für allgemeine Nutzer senken würde.

F4. Wie ist die Preisgestaltung von HappyHorse-1.0 vs Seedance 2.0?

A4. Die Preisgestaltung von HappyHorse-1.0 und Seedance 2.0 unterscheidet sich in Transparenz und Struktur. Basierend auf offiziellen HappyHorse-Preisen kostet das Starter-Paket (12,90 $ für 480 Credits) etwa 0,27 $ pro Video, während das Ultra-Paket (128,90 $ für 8700 Credits) die Kosten auf etwa 0,15 $ pro Video senkt, was bei hohen Volumen kosteneffizienter ist. Im Vergleich folgt Seedance 2.0 typischerweise einem Abonnement- oder nutzungsbasierten Preismodell, mit geschätzten Kosten von 0,10 bis 0,80 $ pro generierter Minute, abhängig von Qualität und Plattformzugang.

Fazit

Aus meiner Bewertung ist die Positionierung klar: HappyHorse-1.0 führt bei Realismus und visueller Qualität, während Seedance 2.0 bei Kontrolle und multimodaler Flexibilität dominiert. Es gibt keinen absoluten Gewinner – nur das richtige Tool für Ihren Workflow. Wenn aktuelle Trends anhalten, wird die nächste Generation von KI-Videomodellen wahrscheinlich beide Stärken verschmelzen und cinematische Qualität sowie volle kreative Kontrolle in einem System liefern.

Kommentar hinterlassen

Bewertung zu HitPaw-Artikeln erstellen