HappyHorse 1.0 vs. Kling 3.0: Ein umfassender KI-Videovergleich

Die rasante Entwicklung der KI-Videoerzeugung im Jahr 2026 hat neue Modelle, insbesondere HappyHorse 1.0, unprecedented Aufmerksamkeit gebracht. Nach dem Spitzenplatz bei mehreren Benchmarks ist es schnell zu einem der am meisten diskutierten KI-Video-Generatoren der Branche geworden. Gleichzeitig bleibt Kling 3.0 als produktionsreifes kommerzielles Tool ein starker Konkurrent. Obwohl beide leistungsstark sind, repräsentieren sie grundlegend unterschiedliche Ansätze zur KI-Videoerstellung, was einen direkten Vergleich unerlässlich macht.

Teil 1. Warum ist HappyHorse 1.0 im Jahr 2026 plötzlich im Trend?

HappyHorse 1.0 hat sich 2026 schnell zu einem der meistdiskutierten KI-Video-Modelle entwickelt, und der Hauptgrund für diesen Anstieg ist seine unerwartete Leistung auf der Artificial Analysis Video Arena Rangliste.

Laut öffentlich verfügbaren Benchmark-Daten belegte HappyHorse 1.0 weltweit den #1 Platz sowohl in den Kategorien Text-zu-Video als auch Bild-zu-Video und übertraf bekannte Modelle wie Kling 3.0 und Seedance 2.0 bei blinden menschlichen Bewertungen.

Besonders bemerkenswert ist, dass die Rangliste auf Elo-Punkten basiert, die aus groß angelegten menschlichen Präferenzabstimmungen abgeleitet wurden, anstatt auf synthetischen Metriken. Das bedeutet, dass das Modell nicht nur technisch stark ist, sondern auch in wahrgenommener visueller Qualität, Eingabeaufforderungsübereinstimmung und Realismus besser abschneidet.

Noch interessanter ist die Art und Weise, wie HappyHorse erschien: ohne offizielle Veröffentlichung, ohne klare Dokumentation und mit begrenztem öffentlichem Zugang, dennoch schaffte es, etablierte kommerzielle Systeme zu übertreffen. Diese Kombination aus starker Benchmark-Dominanz und begrenzter Verfügbarkeit hat seinen raschen Aufstieg in der Aufmerksamkeit genau angetrieben.

Teil 2. Was wissen wir tatsächlich über HappyHorse 1.0?

Obwohl öffentliche Informationen begrenzt sind, lassen sich aus Benchmark-Berichten und geteilten Beispielen mehrere konsistente Muster beobachten. HappyHorse 1.0 scheint sich stark auf semantisches Verständnis und multimodale Erzeugung zu konzentrieren, was ihm ermöglicht, komplexe Eingabeaufforderungen zu interpretieren und in strukturierte visuelle Ausgaben zu übersetzen.

Eine seiner meistdiskutierten Fähigkeiten ist die Verarbeitung von Eingabeaufforderungen mit mehreren Informationsschichten, wie z. B. Interaktionen zwischen Subjekten, Umgebungsdetails und filmischen Elementen wie Kamerabewegung oder Beleuchtung. In vielen gezeigten Beispielen zeigen die generierten Videos eine starke Übereinstimmung mit diesen Anweisungen, was auf eine hohe Eingabeaufforderungs-Treue hinweist.

Darüber hinaus wird HappyHorse häufig als multimodales System beschrieben, das sowohl Video als auch Audio auf integriertere Weise erzeugen kann. Obwohl detaillierte technische Dokumentationen nicht öffentlich verfügbar sind, deutet diese Designrichtung auf einen Versuch hin, Fragmentierung in der Erzeugungskette zu reduzieren und die Synchronisation zwischen verschiedenen Medienelementen zu verbessern.

Es ist jedoch wichtig zu betonen, dass die meisten dieser Beobachtungen aus kontrollierten Benchmarks und kuratierten Ausgaben stammen. Ohne breiteren öffentlichen Zugang ist es schwierig, Stabilität, Wiederholbarkeit und Leistung in vielfältigen realen Szenarien vollständig zu bewerten.

Teil 3. Wie unterscheidet sich Kling 3.0 bei der realen Videoerzeugung?

Kling 3.0 steht für einen reiferen und anwendungsorientierten Ansatz der KI-Videoerzeugung. Anstatt sich auf das Erreichen der höchstmöglichen Benchmark-Ergebnisse zu konzentrieren, legt es Wert auf Konsistenz, Steuerbarkeit und zeitliche Stabilität, die für den realen Einsatz entscheidend sind.

Aus verfügbaren Demonstrationen zeigt Kling besonders gute Leistungen bei der Aufrechterhaltung der Charakteridentität über Frames hinweg, der Positionierung von Objekten und der Gewährleistung fließender Übergänge zwischen Szenen. Diese Fähigkeiten sind für längere Videos oder narrativ getriebene Inhalte essenziell, bei denen schon kleine Inkonsistenzen die Immersion zerstören können.

Ein weiterer bemerkenswerter Aspekt von Kling ist sein relativ vorhersehbares Verhalten. Im Vergleich zu Modellen, die auf Spitzenqualität setzen, liefert Kling tendenziell stabilere und reproduzierbarere Ergebnisse. Das macht es besser geeignet für Arbeitsabläufe, bei denen Nutzer Ausgaben iterativ verfeinern oder visuelle Kontinuität über mehrere Generierungen hinweg aufrechterhalten müssen.

Infolgedessen geht es beim Vergleich zwischen HappyHorse und Kling nicht einfach darum, welches Modell „besser“ ist, sondern darum, welche Art von Leistung für unterschiedliche Anwendungsfälle relevanter ist.

Teil 4. Eingabeaufforderungs-Leistung: Direkte Interpretation vs kontrollierte Erzeugung

Die Handhabung von Eingabeaufforderungen ist einer der kritischsten Aspekte der KI-Videoerzeugung und zeigt auch besonders deutlich die Unterscheidung zwischen diesen beiden Modellen.

HappyHorse 1.0 setzt offenbar auf direkte semantische Interpretation, was bedeutet, dass es komplexe, beschreibende Eingabeaufforderungen verarbeiten und Ausgaben erzeugen kann, die in einem einzigen Versuch der beabsichtigten Szene sehr nahekommen. Dazu gehört die Handhabung mehrerer Entitäten, dynamischer Aktionen und stilistischer Anweisungen, ohne umfangreiche Verfeinerung zu benötigen.

Kling 3.0 hingegen verhält sich eher wie ein geführtes Erzeugungssystem. Obwohl es Eingabeaufforderungen unterstützt, erfordert das Erreichen optimaler Ergebnisse oft iterative Anpassungen und strukturierte Anleitung. Das macht es weniger abhängig von einer einzigen Eingabeaufforderung, aber mehr von der Nutzersteuerung während des Prozesses.

Aus praktischer Sicht spiegeln diese Unterschiede zwei unterschiedliche Philosophien wider. HappyHorse priorisiert die sofortige Übereinstimmung zwischen Eingabe und Ausgabe, während Kling Flexibilität und Kontrolle über den Erzeugungsprozess priorisiert.

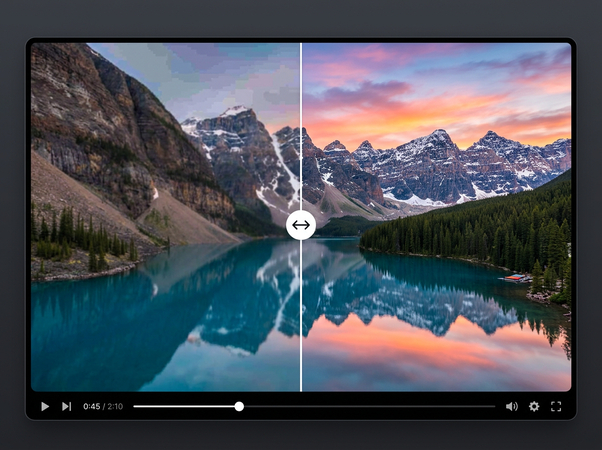

Teil 5. Vergleich der Videoqualität: Spitzenleistung vs stabile Ergebnisse

Im Vergleich der visuellen Qualität wird HappyHorse 1.0 oft mit eindrucksvolleren und detaillierteren Ausgaben assoziiert, insbesondere bei Kurzvideos. Seine Fähigkeit, Eingabeaufforderungsdetails genau widerzuspiegeln, trägt zu einem höheren wahrgenommenen Realismus bei einzelnen Generierungen bei.

Diese Stärke ist jedoch eng an Benchmarkszenarien und kuratierte Beispiele gebunden. Ohne umfangreiche Tests in der Praxis ist es schwierig zu beurteilen, wie konstant dieses Qualitätsniveau über wiederholte Generierungen hinweg gehalten werden kann.

Kling 3.0 verfolgt einen anderen Ansatz, indem es auf Konsistenz statt auf Spitzenleistung setzt. Obwohl seine Ausgaben in manchen Fällen etwas weniger detailliert erscheinen mögen, sind sie in der Regel über mehrere Durchläufe hinweg stabiler. Diese Konstanz ist besonders in Produktionsumgebungen wertvoll, wo Zuverlässigkeit oft wichtiger ist als das Erreichen höchster Qualität in einem einzigen Versuch.

Teil 6. Bewegung und Konsistenz: Kurze Clips vs lange Videoleistung

Die Bewegungsdarstellung unterstreicht den Unterschied der beiden Modelle weiter. HappyHorse zeigt starke Leistungen in kurzen, dynamischen Sequenzen, wo es flüssige Bewegungen erzeugen und Kohärenz innerhalb eines begrenzten Zeitrahmens aufrechterhalten kann.

Kling 3.0 hingegen eignet sich besser für die Erzeugung längerer Videos. Es brilliert darin, Kontinuität über die Zeit zu gewährleisten, sodass Charaktere, Objekte und Umgebungen über längere Sequenzen hinweg konsistent bleiben. Das macht es geeigneter für Storytelling, sequentielle Inhalte und Mehrfachaufnahmen-Kompositionen.

Diese Unterscheidung bestärkt die Vorstellung, dass HappyHorse für wirkungsvolle Highlights optimiert ist, während Kling auf nachhaltige Leistung ausgelegt ist.

Teil 7. Die wirkliche Lücke: Fortgeschrittene Modelle vs Alltagstauglichkeit

Trotz ihrer beeindruckenden Fähigkeiten zeigen sowohl HappyHorse 1.0 als auch Kling 3.0 eine deutliche Kluft zwischen Spitzenforschung und alltäglicher Nutzbarkeit.

HappyHorse bleibt weitgehend unzugänglich, ohne offizielle Veröffentlichung oder öffentliche Schnittstelle. Kling, obwohl zugänglicher, erfordert oft einen strukturierteren und potenziell zeitaufwendigeren Workflow, um optimale Ergebnisse zu erzielen. Für viele Nutzer, insbesondere ohne technische Erfahrung, können diese Einschränkungen die praktische Nutzbarkeit reduzieren.

Dies schafft eine klare Trennung zwischen dem, was diese Modelle theoretisch leisten können, und dem, was Nutzer realistisch erreichen können.

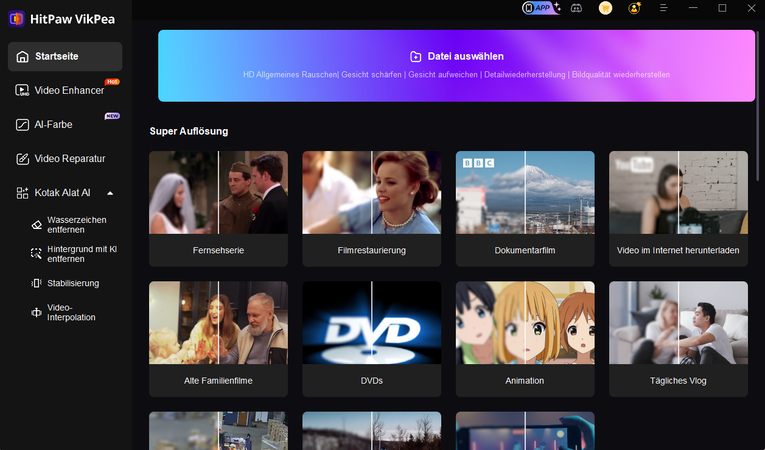

Teil 8. Eine praktischere Wahl: Vereinfachung der KI-Videoerstellung auf dem Desktop

Für Nutzer, die Effizienz, Stabilität und volle Kontrolle über ihren Workflow priorisieren, bieten Desktop-basierte Tools oft eine praktischere Lösung als experimentelle oder nur online verfügbare Systeme.

Anstatt sich auf Modelle mit begrenztem Zugang oder browserbasierte Generatoren zu verlassen, bringen Lösungen wie HitPaw VikPea die KI-Videoerzeugung direkt auf den PC und bieten eine stabilere und flexiblere Erstellung Umgebung.

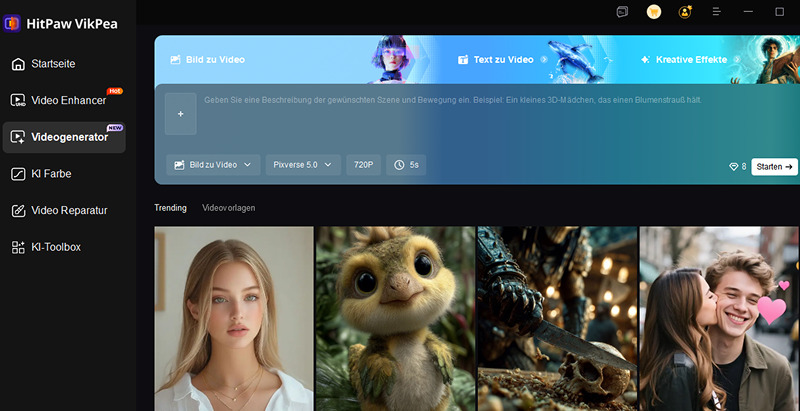

Was ist HitPaw VikPea?

HitPaw VikPea ist ein leistungsfähiger Desktop-KI-Video-Generator und Videoverbesserer, der es Nutzern ermöglicht, Videos lokal aus Text, Bildern oder Clips zu erstellen. Neben der Erzeugung bietet es auch fortschrittliche Videoverbesserungsfunktionen, was es sowohl für kreative Produktion als auch Qualitätsverbesserung geeignet macht.

Wichtige Funktionen von HitPaw VikPea

- KI-Videoerzeugung aus Text, Bildern oder bestehenden Clips

- Eingebaute kreative Effekte für animierte und filmische Szenen

- Unterstützung für mehrere fortschrittliche KI-Modelle (z. B. Kling, Pixverse, Seedance und mehr)

- Optimierte Exportformate für Plattformen wie TikTok, Instagram und X

- Videoverbesserungswerkzeuge: Hochskalierung, Rauschreduzierung und Farbkorrektur

- Batch-Verarbeitung und Multi-Format-Export für effiziente Arbeitsabläufe

Wie man mit VikPea ein KI-Video erstellt

-

Schritt 1. Starten Sie HitPaw VikPea und wählen Sie die Video Generator im Hauptinterface aus.

-

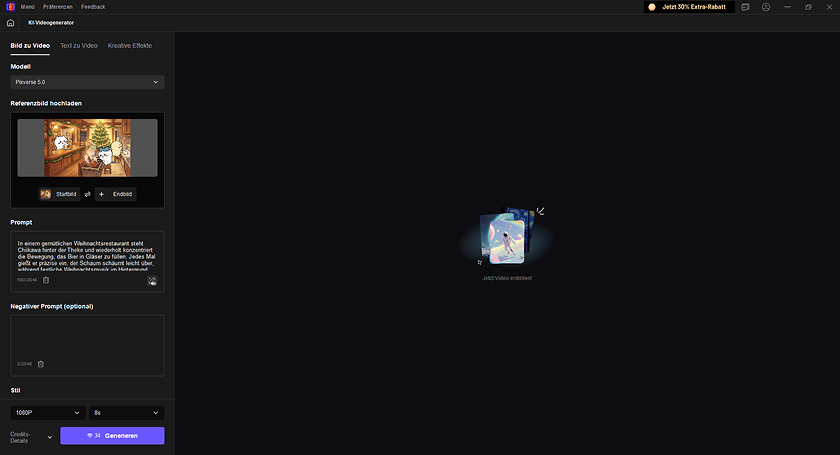

Schritt 2. Wählen Sie, ein Video aus Text oder Bild zu erstellen. Geben Sie eine detaillierte Eingabeaufforderung ein oder laden Sie ein Referenzbild hoch, um Ihre Szene zu definieren.

-

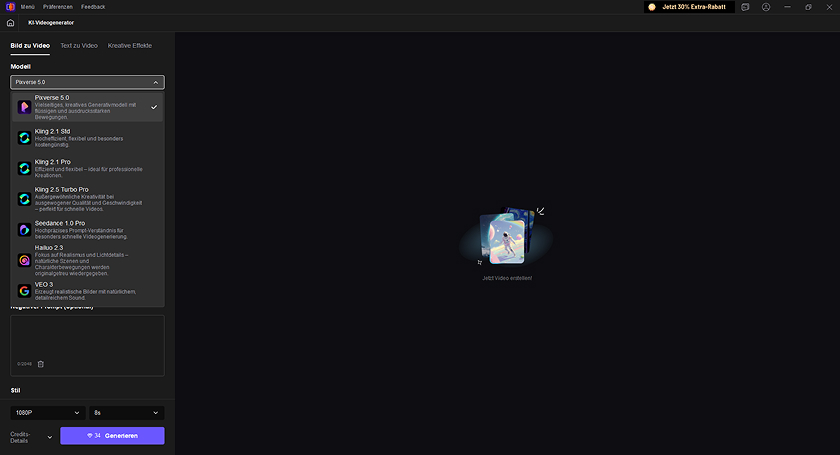

Schritt 3. Wählen Sie Ihr bevorzugtes KI-Modell aus den verfügbaren Optionen aus.

-

Schritt 4. Passen Sie Auflösung, Dauer, Seitenverhältnis und visuellen Stil nach Ihren Bedürfnissen an.

-

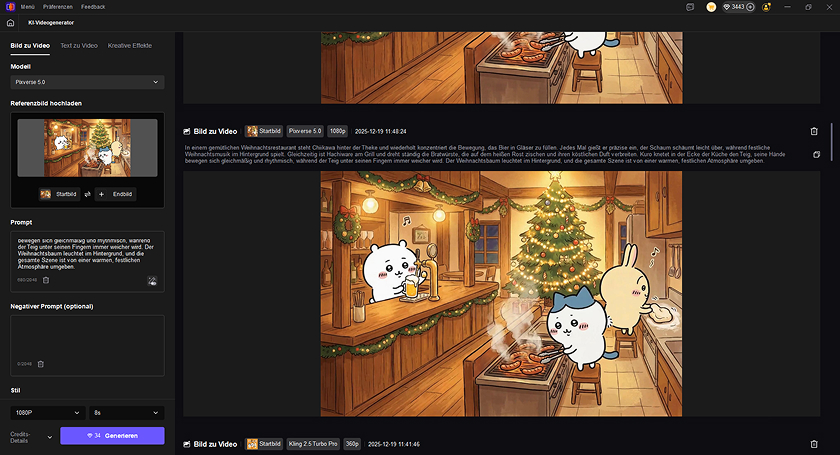

Schritt 5. Klicken Sie auf Generate. Nach Abschluss können Sie das Video vorab ansehen, bei Bedarf verfeinern und lokal exportieren.

Im Vergleich zu experimentellen Modellen wie HappyHorse 1.0 oder workflow-intensiven Systemen wie Kling 3.0 bietet eine Desktop-Lösung wie VikPea ein ausgewogeneres Erlebnis — das Zugänglichkeit, Leistung und Zuverlässigkeit in der Praxis kombiniert.

Fazit

HappyHorse 1.0 und Kling 3.0 zeigen, wie schnell sich die KI-Video-Technologie entwickelt, verdeutlichen aber auch, dass die Zugänglichkeit weiterhin eine Herausforderung darstellt. Für die meisten Nutzer ist das Ziel nicht, die Grenzen von KI-Modellen zu testen, sondern Inhalte effizient zu erstellen. Wenn Benutzerfreundlichkeit und Geschwindigkeit in Ihrem Workflow wichtiger sind, bieten Tools wie HitPaw Online AI Video Generator einen praktischeren Weg, um Ideen zum Leben zu erwecken.

Kommentar hinterlassen

Bewertung zu HitPaw-Artikeln erstellen